.jpg) Une femme américaine devient « biologiquement » plus jeune après le suivi d’une thérapie génique que sa propre société a développé. Où quand Dorian Gray fait du commerce sans nuance (attention ! jeu de mots) en mode transhumanisme 2.0.

Une femme américaine devient « biologiquement » plus jeune après le suivi d’une thérapie génique que sa propre société a développé. Où quand Dorian Gray fait du commerce sans nuance (attention ! jeu de mots) en mode transhumanisme 2.0.

Elizabeth Parrish, directrice générale de Bioviva USA Inc., est devenue, à grand renfort de communication, le premier être humain « à rajeunir » grâce à la thérapie génique développée par cette même entreprise. Cette dernière, sur la page d’accueil de son site internet, promet de démocratiser, dans un avenir proche, la thérapie génique et cellulaire. Dans un environnement convivial et confortable, les médecins de la société sont là pour corriger, avec précision, votre patrimoine corporel en voie de décrépitude.

L’un des premiers développements de la société, trouve une application dans la lutte contre le vieillissement, ce qui constitue toujours un excellent business plan compte tenu d’une corrélation établie entre âge et solvabilité. Ce philtre de jeunesse cible les télomères dont la taille serait proportionnelle à notre délai de péremption. De par leur structure particulière, les télomères requièrent d’être maintenus par une transcriptase inverse cellulaire spécifique appelée télomérase. En absence ou dans le cas de défaillance de télomérase, les télomères raccourcissent progressivement, jusqu’à atteindre une taille critique qui entraîne un arrêt des divisions cellulaires caractérisant la sénescence réplicative. Ainsi, les télomères forment une structure essentielle dans le contrôle de la viabilité cellulaire. Ceux-ci permettent de maintenir l’équilibre entre le vieillissement cellulaire et le risque de prolifération cellulaire incontrôlée.

Le score des télomères est calculé en fonction de la longueur des télomères des lymphocytes T. Ce résultat est basé sur la moyenne des longueurs des télomères des lymphocytes T par rapport à celle de la population américaine de même classe d’âge. Plus le score est élevé plus les cellules concernées seront considérées comme « jeunes » et par extension, plus le patient sera lui-même considéré comme biologiquement jeune. En septembre 2015, Elizabeth Parrish âgée de 44 ans (un peu jeune notre candidate au rajeunissement) a reçu deux des thérapies géniques expérimentales de sa propre entreprise:

- l’une pour la protéger contre la perte de la masse musculaire liée à l’âge

- l’autre combattant cette diminution quantitative de cellules souches associée au vieillissement et à ses conséquences

Le test évoqué ici a été initialement conçu pour démontrer l’innocuité de la dernière génération des thérapies géniques et cellulaires. Si les premières données s’avèrent exactes et incontestables, il s’avère que ce test constituera une première mondiale: l’allongement des télomères dont le rognage était perçu comme inéluctable, irréversible. Dans le viseur de Bioviva, le vieillissement réversible est donc en ligne de mire ou du moins les gérascophobes que le test aura rassuré voire convaincu.

Auparavant, la thérapie génique a été utilisée pour allonger les télomères des cellules murines cultivées, mais jamais sur un patient humain. En septembre 2015, les scores des télomères des globules blancs d’Elizabeth Parrish ont été collectés, par une clinique spécialisée au niveau des tests de laboratoire (SpectraCell à Houston), immédiatement avant que les traitements ne lui furent administrés. Ces scores ont révélé que les télomères d’Elizabeth Parrish étaient inhabituellement courts pour son âge, la laissant précocement vulnérable aux maladies liées à l’âge. En mars 2016, les mêmes tests ont été effectués par SpectraCell. Ces derniers ont révélé que ses télomères avaient « allongé » d’environ 20 ans, passant de 6,71kb à 7,33kb: les globules blancs d’Elizabeth Parrish sont devenus biologiquement plus jeunes. Ces résultats ont été contrôlés de façon indépendante par les fondations: Bruxelles Heales (Healthy Company Life Extension), et la fondation britannique Biogerontology Research Foundation.

Elizabeth Parrish mais qui aimerait bien le devenir

Elizabeth Parrish argumente: « actuellement, peu de thérapies offrent de réels avantages pour les personnes souffrant de maladies du vieillissement. La modification du mode de vie a un impact que limité pour le traitement de ces maladies. Les progrès de la biotechnologie apparaît être une meilleure solution, [avec ce test] nous avons fait l’histoire! ». Plusieurs signaux alimentent le scepticisme des membres de la communauté scientifique. Ainsi le fait qu’il n’y ait pas aujourd’hui de corrélation établie entre la longueur des télomères et la santé d’une personne. « C’est comme pour les cheveux gris, ce n’est pas parce qu’on se les teint qu’on vivra plus longtemps » commente Dana Glei, chercheuse à l’Université de Georgetown. Bioviva continuera de contrôler le sang de Parrish pendant les années à venir. Il reste à évaluer si le succès observé sur des leucocytes peut être étendu à d’autres tissus ou organes, est ce que ce teindre les cheveux ou rallonger ses télomères nous permet de perdre (ou gagner, cela dépend du point de vue) quelques années. Toutes ces interrogations pourraient avoir leurs réponses dans les cellules d’Elizabeth Parrish, le «patient zéro» de la thérapie génique réparatrice. Depuis ses premières injections de thérapie géniques, Bioviva a suscité un intérêt mondial, le scepticisme de communauté scientifique, l’engouement des investisseurs et à fourni un cas d’école pour tout bon bioéthicien.

Les cellules photovoltaïques ont un potentiel considérable pour satisfaire les besoins futurs en énergie renouvelable, cependant des méthodes efficaces et évolutives de stockage de l’électricité intermittente qu’elles produisent, sont aujourd’hui attendues pour la mise en œuvre, à grande échelle, de l’énergie solaire. Un stockage de cette énergie solaire pourrait passer par la case carburant. Le travail, présenté dans PNAS de février 2015 (Efficient solar-to-fuels production from a hybrid microbial–water-splitting catalyst system), rapporte le développement d’un système bioélectrochimique évolutif, intégré dans lequel la bactérie Ralstonia eutropha est utilisée pour convertir efficacement le CO2, avec l’hydrogène et l’oxygène produits à partir de dissociation de l’eau, en biomasse et alcools (cf. schéma ci-contre). Les systèmes photosynthétiques artificiels peuvent stocker l’énergie solaire et réduire chimiquement le CO2. Le système de fractionnement-biosynthétique hybride est basé sur un système de catalyseur inorganique, relativement abondant sur Terre (nécessairement sinon écologiquement ce ne serait pas terrible, avouons le…), biocompatible pour séparer l’eau en hydrogène et oxygène à des tensions basses. Lorsqu’elle est cultivée en contact avec ces catalyseurs, Ralstonia eutropha consomme le H2 produit pour synthétiser de la biomasse et des carburants voire d’autres produits chimiques, à partir de faible concentration de CO2 – sous entendu à des concentrations voisines de celles présentes dans l’air. Ce système évolutif a une efficacité énergétique de réduction de CO2 d’ ~ 50% lors de la production de la biomasse bactérienne et d’alcools. Ce dispositif hybride couplé à des systèmes photovoltaïques existants donnerait une efficacité énergétique de réduction des émissions de CO2 d’environ 10%, supérieure à celle des systèmes photosynthétiques naturels ! Nous en conviendrons la bactérie utilisée ici est génétiquement modifiée afin d’orienter son métabolisme vers une voie anabolique d’intérêt.

Ces travaux ouvrent la voie vers la « photosynthèse de synthèse ». Dans cette configuration intégrée, les rendements du solaire à la biomasse vont jusqu’à 3,2% du maximum thermodynamique pour dépasser celle de la plupart des plantes terrestres. En outre, l’ingénierie de R. eutropha a permis la production d’isopropanol jusqu’à 216 mg/L, le plus haut rendement jamais rapporté (> 300 %). Ce travail démontre que les catalyseurs d’origine biotique et abiotique peuvent être interfacés, intégrés… pour permettre à partir de l’énergie solaire, du CO2 et de quelques bactéries de développer des systèmes efficaces stockant une énergie intermittente sous forme de molécules organiques (le biomimétisme est la vraie tendance du moment).

Dans cette première version (celle du PNAS) l’électrode utilisée en nickel-molybdène-zinc s’est avérée toxique pour les bactéries qui voyaient leur ADN attaqué… dans cette version améliorée publiée dans Science (3 juin 2016) , l’électrode toxique a été changée par une autre composée de cobalt-phosphore… Selon Daniel Nocera, le promoteur de l’étude : « Cela nous a permis d’abaisser la tension conduisant à une augmentation spectaculaire de l’efficacité. »

, l’électrode toxique a été changée par une autre composée de cobalt-phosphore… Selon Daniel Nocera, le promoteur de l’étude : « Cela nous a permis d’abaisser la tension conduisant à une augmentation spectaculaire de l’efficacité. »

Nocera et ses collègues ont également été en mesure d’élargir la gamme de produits q’un tel système est capable de synthétiser pour y inclure l’isobutanol (un solvant) et l’isopentane (utilisé dans des boucle fermée pour actionner des turbines), ainsi que le PHB (un précurseur de bioplastiques). La conception chimique du nouveau catalyseur permet également une certaine « auto-régénération, » ce qui signifie que l’électrode ne sera pas lessivée au fur et à mesure de son activité.

En cancérologie, l’allogreffe de moelle osseuse s’inscrit dans un parcours thérapeutique notamment comme traitement de consolidation après une chimiothérapie. Aussitôt, les notions de rejet ou d’acceptation du greffon apparaissent et il devient indispensable que les systèmes HLA (Human Leucocyt Antigens, découvert en 1950) du donneur et du receveur soient les plus proches possibles.

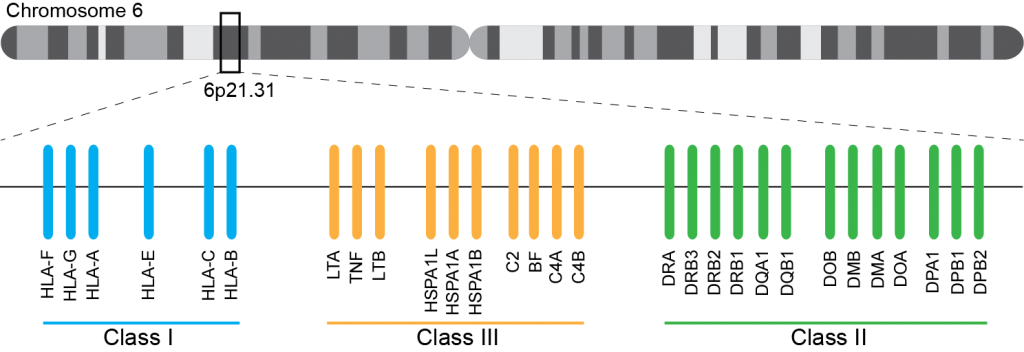

Ce système immunogène, situé sur le bras court du chromosome 6 chez l’homme, est caractérisé par son polygénisme et son polymorphisme qui sont à l’origine d’une grande variabilité interindividuelle et en fait le déterminant principal du résultat de greffe. L’ensemble des gènes HLA sont subdivisés en trois régions du chromosome 6 qui contiennent chacune de nombreux gènes avec ou sans fonction immunologique. On distingue ainsi la région CMH de classe I, de classe II, et de classe III.

A ce jour, un rendu de typage est ciblé sur une portion génomique restreinte codant pour le HLA. Il s’agit de l’exon 2 et 3 des loci HLA-A, HLA-B et HLA-C (région I), l’exon 2 et 3 des loci HLA-DQ (DQ-A et DQ-B) et l’exon 2 pour HLA-DR (DRA et DRB1), où repose prés de 70% du polymorphisme. La région III ne renfermant pas de gènes intervenant dans la présentation antigénique.

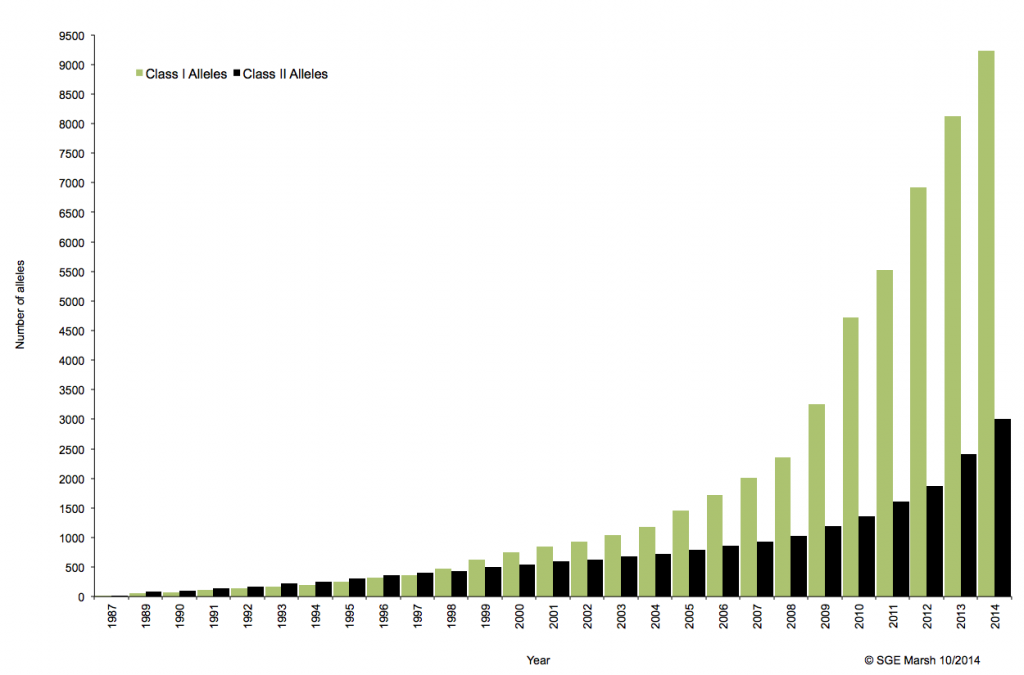

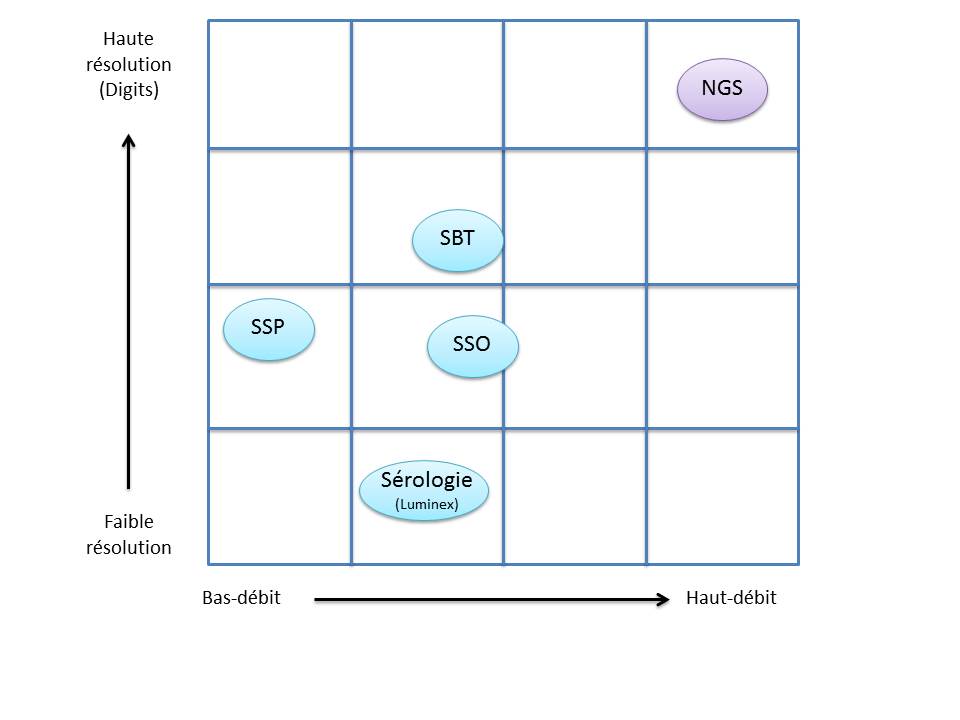

C’est ainsi que différentes approches de typages ont été développées et l’avènement de la technique de PCR au milieu des années 1980 a pallié aux limites de résolution de la sérologie employée jusqu’alors. D’un typage rendu au niveau générique (2 Digits), la « PCR-SSO » (Sequence Specific Oligonucleotide) et la « PCR-SSP » (Sequence Specific Primer) développées dans les années 1990 ont permis d’accéder à un résultat allélique (4 Digits). Cette avancée technologique s’est poursuivie la décennie suivante avec la « PCR-SBT » (Sequence Based Typing) ou séquençage « Sanger » puis plus récemment avec la PCR en temps réel (ex: linkage). Toutes ces techniques de biologie moléculaire ont permis de mettre en avant le polymorphisme et la grande diversité génétique du HLA. Chaque année, de nombreux allèles sont découverts, alimentant continuellement la banque de données de référence IMGT.

Associé à cette augmentation constante du nombre d’allèles typés, le nombre d’ambigüités croît et met progressivement en difficulté les technologies conventionnelles qui atteignent leurs limites. De plus, le pourcentage de réussite des allogreffes n’atteint environ que 50%. L’exploitation du reste de l’information génomique permettrait potentiellement d’améliorer cette performance par un typage plus affiné.

Le recours au séquençage nouvelle génération apparait donc inévitable. En plus de gérer les ambiguïtés par un séquençage allélique, le NGS permet de traiter simultanément de grandes quantités d’échantillons réduisant ainsi le coût unitaire, d’accéder à un niveau de résolution supérieur (4,6 ou 8 digits) tout en ayant la capacité de cibler des loci entier (Long Range PCR).

Ainsi, plusieurs stratégies existent avec leur solution technique adaptée à la préparation de la matrice d’ADN à séquencer:

– L’amplification ciblée des régions d’intérêt par PCR de fusion. Cette approche permets un gain de temps et une réduction des coûts en s’affranchissant des étapes de fragmentation, ligation, et autres purifications… .Par ailleurs elle n’est pas la mieux adapté dans le cas d’une couverture de séquençage de l’ensemble de la région génomique HLA.

– L’amplification par « Long Range PCR » permet une couverture complète des différents loci étudiés. Les fragments de plusieurs Kb subissent alors une fragmentation, une ligation des adaptateurs et indexation. Cette approche permet d’accéder à davantage d’informations (régions exoniques et introniques).

– La capture de séquences par hybridation. Même si cette solution est bien caractérisée elle n’est pas si efficace en terme de capture avec une disparité selon la taille des fragments.

– Le séquençage de génome entier ou d’exome. Cette approche est la moins biaisée et couvre tous les gènes du système HLA. Paradoxalement, l’analyse nécessite beaucoup trop de ressources pour une utilisation en routine et ne permets pas de traiter autant d’échantillons simultanément.

Plusieurs sociétés commerciales proposent des solutions clé en main depuis la préparation des échantillons (avec l’option « Long Range PCR » qui semble la plus plébiscité) jusqu’à l’analyse de résultats via leur logiciel dédié. Certaines sont en cours de validation de méthode pendant que d’autres tentent d’inonder le marché. Parmi elles, Gendx, Omixon, Illumina, One lambda, Life technologies, Immucor, etc…

L’exploitation des capacités et caractéristiques des solutions de séquençage à haut-débit permettrait d’affiner considérablement le typage HLA. Ainsi le décryptage de l’ensemble des régions codantes et non-codantes du génome d’intérêt représente un enjeu important dans la réussite des greffes. Par ailleurs, cette approche nécessitera une mise à jour considérable des banques de données (IMGT) avec une validation de nombreux nouveaux allèles.

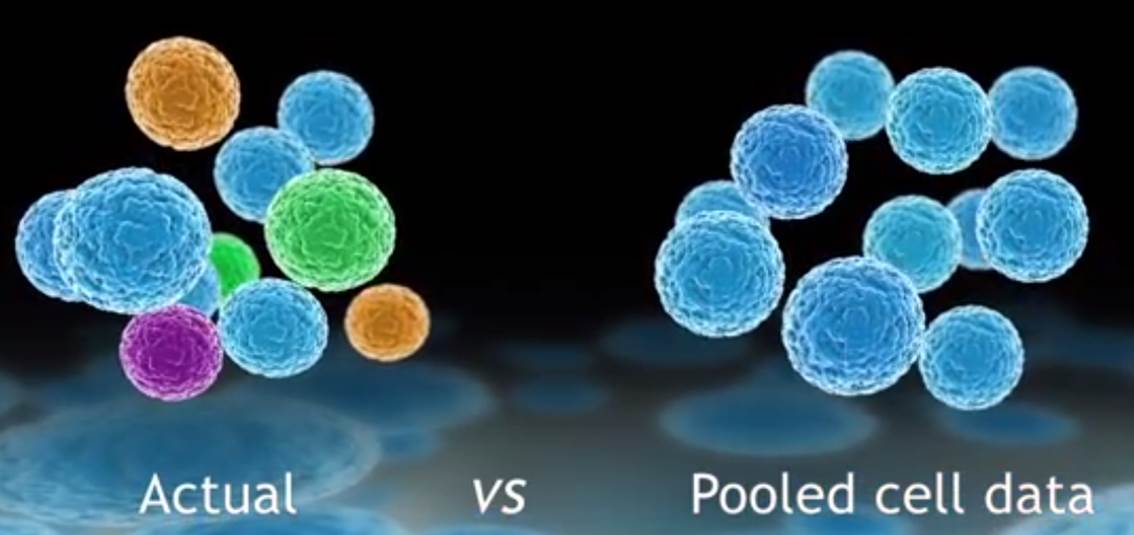

Au cours des dix dernières années, la génomique connait une avancée technologique indéniable au travers des différents procédés de séquençage à haut-débit de deuxième génération. Néanmoins, certaines limites techniques subsistent, notamment par rapport à la quantité d’ADN requit, impliquant donc son extraction à partir de plusieurs millions de cellules. Cette contrainte implique une dilution de l’information pour des cellules aux fonctions biologiques bien souvent hétérogènes jusqu’au sein d’un même tissu.

En attendant la démocratisation du séquençage de troisième génération (Séquençage ADN sans amplification clonale) aux caractéristiques techniques qui permettraient un virage vers la génomique à l’échelle de la cellule unique , des méthodes alternatives appliquées à la seconde génération se développent afin d’accéder à cette hétérogénéité cellulaire. Ces solutions s’accompagnent donc, en amont du séquençage, d’une inévitable amplification de l’ADN de la cellule, préalablement isolée soit microdissection laser, système de microfluidique (ex: C1 Fluidigm), cytométrie en flux, ou encore micropipettage.

Ce poste est donc l’occasion de présenter la méthode d’amplification MALBAC, pour Multiple Annealing and Looping Based Amplification Cycles (Science, Zong et al.).

La méthode MALBAC repose sur l’utilisation de primers spécifiques (séquence de 8 nucléotides variables s’hybridant aléatoirement sur l’échantillon, couplée à une séquence connue de 26 nucléotides) générant des amplicons aux extrémités complémentaires. Cette particularité favorise la formation d’une boucle, évitant ainsi aux brins néo-synthétisés de servir à nouveau de matrice à la PCR et d’engendrer un biais d’ amplification (contrairement à la MDA). Ces étapes d’amplifications quasi-linéaires sont répétées cinq fois, puis les amplicons sont amplifiés par PCR exponentielle classique, en amont du séquençage.

MALBAC favorise une meilleure couverture de séquençage ainsi qu’une amplification plus uniforme (cf représentation ci-dessous) . De par ses performances, elle surclasse les méthodes conventionnelles tel que PEP-PCR, DOP-PCR ou encore MDA, pour Multiple Displacement Amplification, méthode la plus répandue depuis dix ans. Jusqu’à 83% de couverture à 10X de profondeur contre 45% pour la MDA. Parmi les autres atouts, la quantité d’ADN initiale requise n’est que de 0.5pg (contre 1000pg pour la MDA) et la polymérase Bst associée connait un taux d’erreur de 1/10000 bases.

Les performances de cette méthode permettent ainsi de reconsidérer les études génomiques ciblant un matériel biologique rare. Parmi elles, l’analyse de cellules tumorales circulantes, de tissus microdisséqués, de cellules embryonnaires, de micro-organismes, de cellules foetales circulantes, , etc…

Vous qui cherchez une méthode permettant de mettre en évidence des variants rares au sein d’une population hétérogène de produits PCR, l’ice-COLD PCR est peut être faite pour vous.

En effet, identifier des variants rares noyés dans de l’ADN « sauvage » a été techniquement une demande forte de divers champs d’expertises médicales tels que la cancérologie, l’infectiologie et le diagnostic prénatal. Nous avons déjà parlé sur Biorigami, d’une approche assez largement répandue qui consiste à séquencer très profondément (à haut-débit donc) tout ou partie de génome en vue d’identifier ces variants rares potentiellement associés à des phénomènes de résistance à des antibiotiques (à titre d’exemple vous pouvez consulter le travail d’Eurekagenomics présenté sous forme de poster)

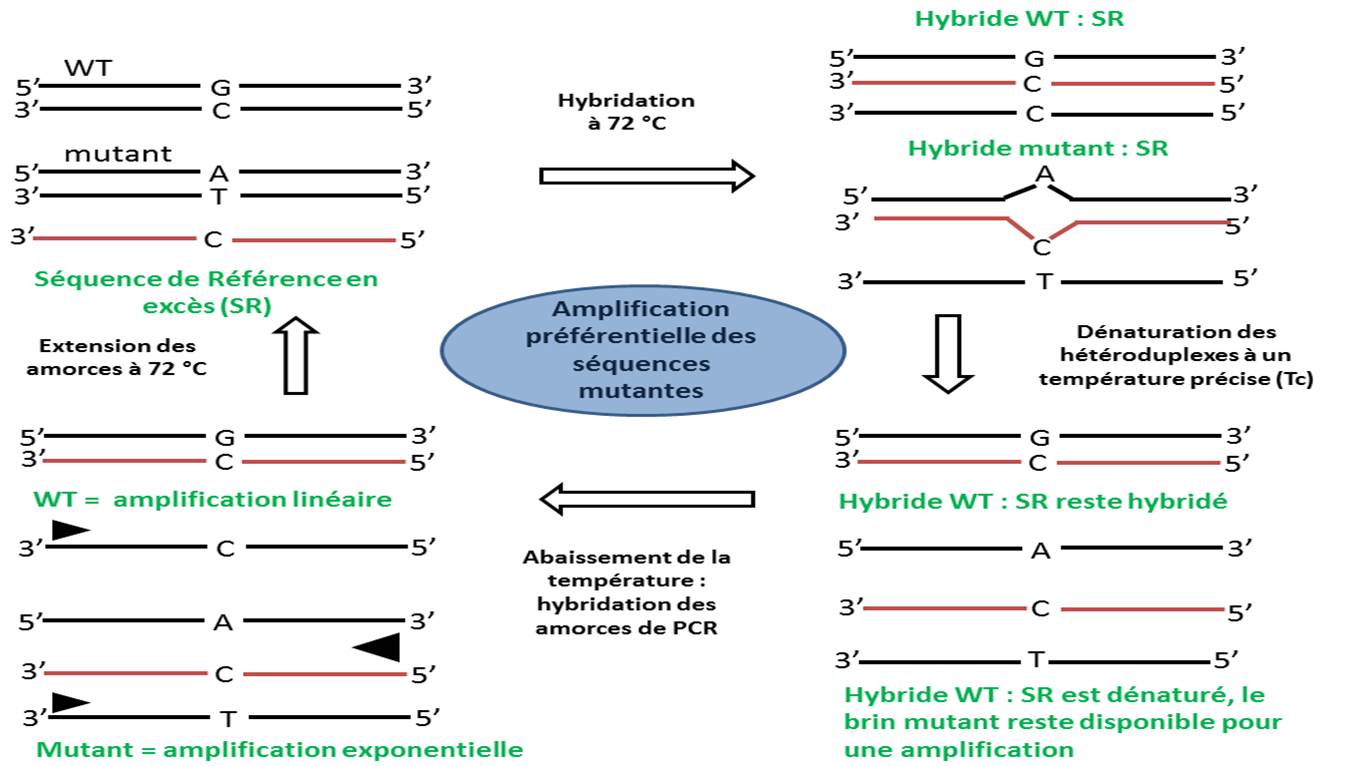

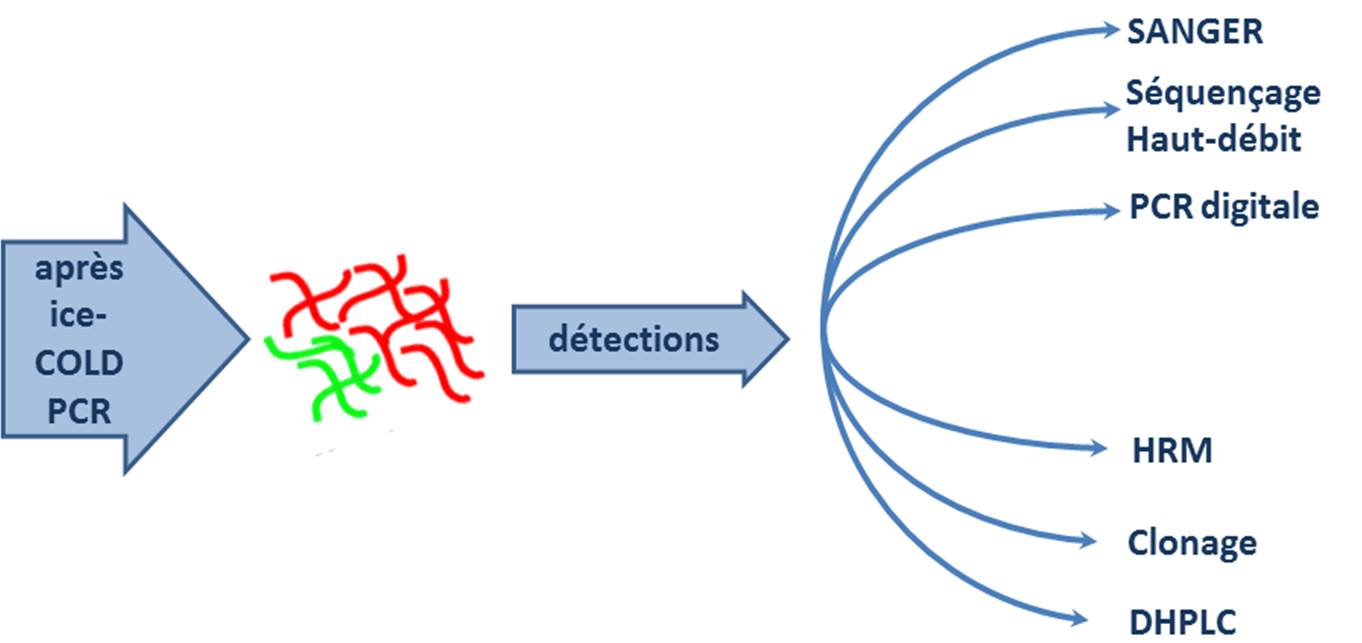

Derrière l’acronyme tautologique, ice COLD, se cache la terminologie : Improved & Complete Enrichment CO-amplification at Lower Denaturation temperature PCR, ce qui pourrait se traduire en français approximatif par : une amélioration de la COLD PCR qui est elle même : une co-amplification à sub-température de dénaturation-PCR. Qu’est ce qui se cache derrière cet énième acronyme ? Pour y voir plus plus clair, voici pour commencer, ce petit schéma:

En observant le schéma ci-dessus, commençons en haut à gauche : nous avons donc des séquences double brin sauvage en large quantité et potentiellement de l’ADN mutant. En premier lieu, il convient de designer des amorces permettant une amplification du locus d’intérêt (pour un amplicon de taille généralement autour de 100 pb). Il vous faudra ensuite une séquence (notée SR sur le schéma) 3′ phosphate pour prévenir des amplifications lors des phases de PCR. Cet oligonucléotide (employé autour d’une concentration de 25 nM finale) viendra s’hybrider parfaitement sur la cible ADN wt et constituera un hétéroduplexe avec toute cible contenant un polymorphisme. A l’aide de la connaissance du Tm (melting temperature ou température de fusion) de l’homoduplexe ADNwt//SR -(note : pour ce faire, il sera nécessaire de designer un autre couple d’amorces afin que la taille du brin SR amplifiée soit égale au brin SR qui lui même est plus court que l’amplicon généré par les premières amorces designées) acquise par la réalisation de courbe de fusion par PCR en temps réel, les hétéroduplexes seront dénaturés en chauffant à une température critique (Tc), généralement de 1 °C inférieure au Tm constaté de l’homoduplexe. Nous sommes, à l’issue de cette étape, en bas à droite de notre schéma, ensuite il restera à réaliser la PCR qui ciblera largement préférentiellement les ADNs disponibles, dénaturés… donc ceux portant des mutations.

Les avantages de cette technique sont multiples :

Cette technique peut être appliquée sur diverses types d’échantillons : ADN fœtal circulant (sérum, plasma), cellules tumorales circulantes, divers fluides corporels, FNA, FFPE, TMA. Elle nécessite de petites quantités de tissu ou d’ADN et peut permettre détecter toutes les mutations présentes au sein du locus amplifié.

En aval, cette méthode accepte une foultitude de techniques de détection qui permettent de réaliser le diagnostic à proprement parlé des mutations :

L’ice-COLD PCR est une technique qui est peu exigeante, elle nécessite de disposer d’un thermocycleur assez correct et d’un fournisseur d’oligonucléotides performant (rapide et pas cher) et évidemment de s’y connaitre quelque peu en PCR…

Si, par hasard, vous souhaiteriez plus de précisions, voici une vidéo des plus instructives, l’occasion pour nous de présenter l’excellent site LabTube.com dont une capture d’écran vous est proposée ci-dessus. Ce site internet héberge moult vidéos de conférences, diapositives illustrant une technique (dont l’ice COLD-PCR), bref une source d’informations techniques dont il ne faut pas se priver. Pour preuve au sujet de la recherche de mutations rares voici une présentation de Jorg Tost, directeur du laboratoire épigénétique et environnement (LEE), du Centre national de génotypage, Institut de Génomique/CEA.

Le développement des technologies à haut-débit dédiés aux petits ARNs non codant, récemment identifiés (fin des années 90), voit régulièrement déferler des solutions commerciales et libres pour l’analyse gene ontology.

La puissance de cet outils réside dans:

2) l’incorporation de deux algorithmes pour la caractérisation des fonctions biologiques et pathways sur la base de la prédiction des gènes cibles et faisant appel à cinq bases de données (KEGG, Biocarta, PID, Reactome et Gene Ontology – cf fig. ci-dessous, rectangle orange).

Citation

PLoS One. 2012;7(8):e42390. doi: 10.1371/journal.pone.0042390. Epub 2012 Aug 1.

miRSystem: an integrated system for characterizing enriched functions and pathways of microRNA targets.

Lu TP1, Lee CY, Tsai MH, Chiu YC, Hsiao CK, Lai LC, Chuang EY.

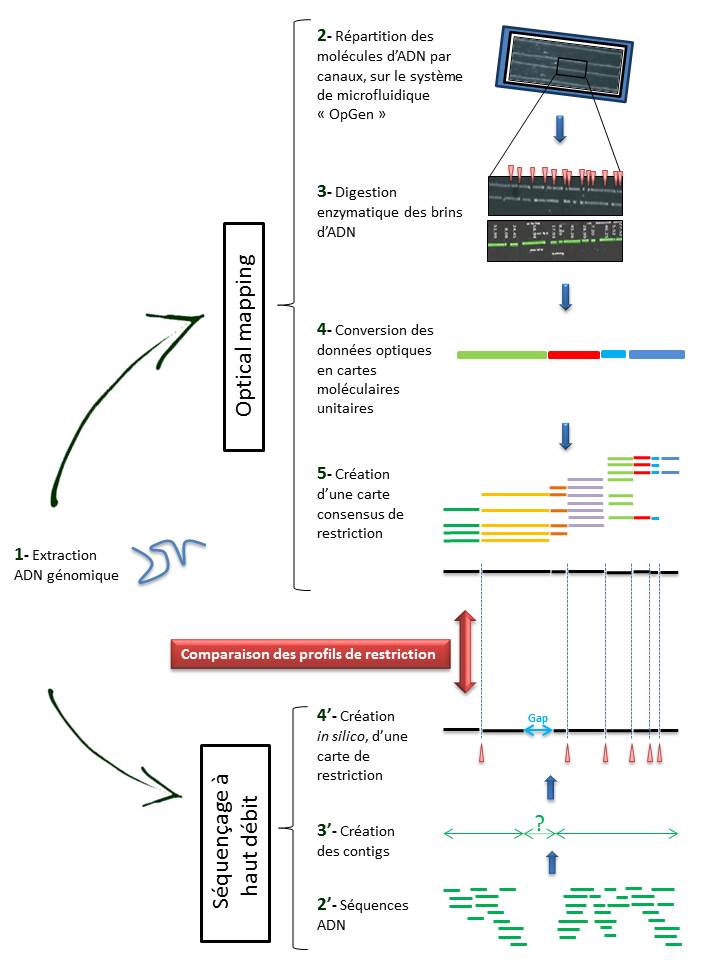

Parmi les technologies dédiées à la génomique, l’ « Optical Mapping » fait figure d’outil qualifiable d’alternatif. Cette approche repose sur une représentation graphique des sites de restrictions enzymatiques au travers d’un génome complet.

Parmi les technologies dédiées à la génomique, l’ « Optical Mapping » fait figure d’outil qualifiable d’alternatif. Cette approche repose sur une représentation graphique des sites de restrictions enzymatiques au travers d’un génome complet.

Les applications concernent aussi bien la génomique comparative (détection des délétions, insertions, inversions ou translocations), que le typage de souches (comparaison des cartes de restrictions). Aussi, conjuguée aux technologies de séquençage à haut-débit, elle permet également de répondre aux illusions fréquentes de l’obtention d’un « draft » de génome d’intérêt, nouvellement séquencé. Actuellement, OpGEN est la seule société proposant une solution semi-automatisée de cette technologie.

Techniquement, l’ « Optical mapping » consiste en (Cf fig ci-dessous):

– Une immobilisation des fragments d’ADN génomique extraits (1) au sein de canaux intégrés dans un support dédié (Argus System – OpGen) (2).

– Chaque molécule subit une digestion enzymatique (endonucléase de restriction) générant des sites de clivage, symbolisés ci dessous par les espaces (3).

– Le logiciel d’analyse (MapSolver) convertit ces données optiques en cartes moléculaires unitaires (4), qui alignées, fournissent une carte de restriction consensus du génome étudié (5).

L’utilisation de cette méthode, dans la perspective d’un assemblage efficace de génome, ne cesse de croître. En effet, elle permet de pallier les limites des NGS (Homopolymères, zones de génome peu ou non couvert) qui ne permettent bien souvent d’aboutir qu’à un nombre restreint de contigs (3′).

Il convient alors de créer une carte de restriction, in silico, de ces contigs (4′), à leur tour alignés sur l’ « optical map » du génome, sur la base des sites de clivage. Cette comparaison permet alors de positionner les contigs entre eux, de les orienter et de mettre en lumière les hypothétiques gaps. Le scaffold des contigs ainsi établi, associé à un séquençage Sanger des gaps permettent ainsi d’aboutir à un « draft » du génome étudié.

L’ « optical mapping » apparait comme un outil fiable et utile dans l’assemblage de génome, d’autant qu’il fait appel à une technique différente, indépendante mais à la fois très complémentaire au séquençage à haut débit.

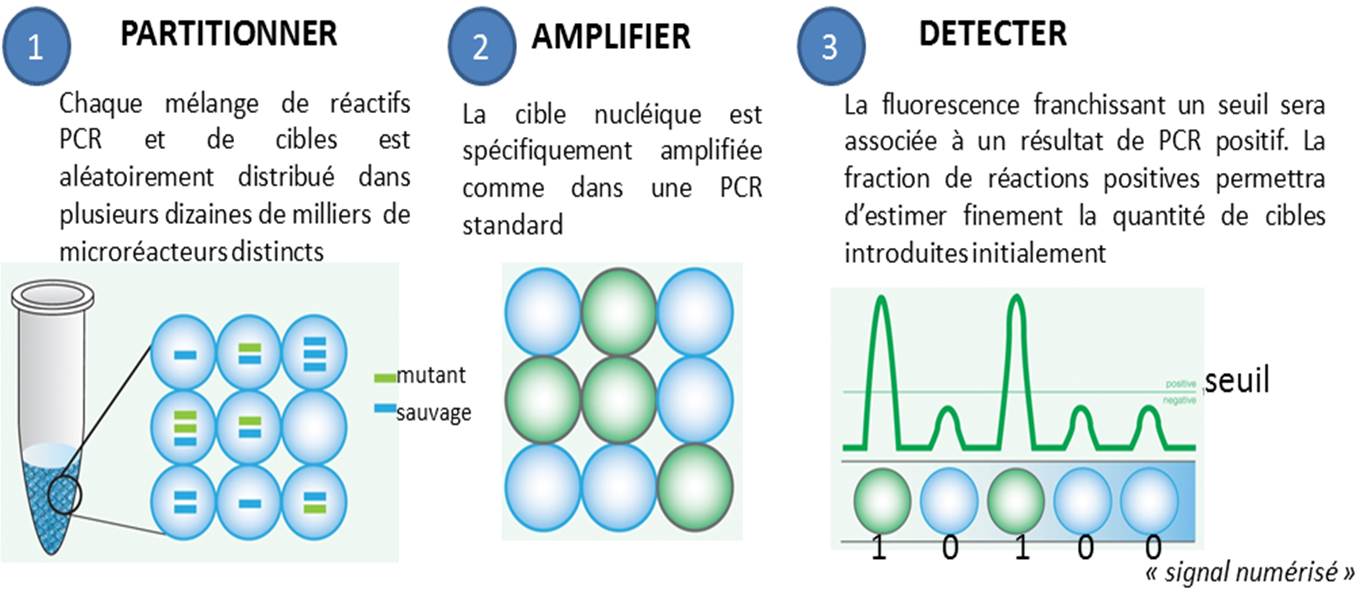

La PCR en point final, celle qui se termine souvent par un dépôt sur gel d’agarose, ainsi que la PCR quantitative, dans laquelle on suit l’évolution de la libération de molécules fluorescentes dont le décollage plus ou moins précoce dépend de la quantité de matrice initialement introduite, se voient déclinées en versions numériques. Par numérique est entendu ici, qu’une PCR peut prendre deux valeurs : 0 ou 1 (idéalement, 0 quand aucune cible n’est introduite au départ d’une PCR et que par voie de conséquence aucun signal issu d’amplification n’est observé, et 1 pour l’exact inverse).

Le principe de la PCR numérique est simple au niveau du concept mais techniquement beaucoup plus difficile à mettre en application. Il s’agit de multiplier le nombre de bio-réacteurs disponibles, ainsi, un échantillon sera partitionné en des milliers de compartiments distincts. Ensuite chaque compartiment sera considéré comme autant de réacteurs indépendants… donc en fin de PCR autant de réactions montrant oui ou non une amplification (autant de 0 et de 1), renvoyant à un système binaire. L’application de la Loi de Poisson permettra ensuite d’estimer très finement la quantité initiale de cibles présentes dans l’échantillon de départ.

Les avantages de la PCR numérique par rapport à la qPCR classique sont assez évidents :

– elle permet une quantification absolue sans établir une courbe standard préalable

– elle est plus sensible voire beaucoup plus sensible. Raindance annonce ainsi détecter un mutant parmi 250 000 molécules sauvages avec une limite inférieure de détection de 1 parmi 1.000.000

– elle est moins sensible aux inhibiteurs. Le fait de diluer la matrice ADN complexe de départ pour la répartir dans un nombre important de réacteurs permet de favoriser le départ de PCR

– elle est nettement plus précise. La technologie sera d’autant plus précise que le nombre de compartiments, le nombre de micro-réacteurs sera important

L’article « Digital PCR hits its stride » (La PCR numérique franchit un nouveau cap) de Monya Baker dans le Nature Methods (juin 2012) permet un aperçu de la technologie qui est passée du concept à des solutions commerciales qui se veulent de plus en plus accessibles.

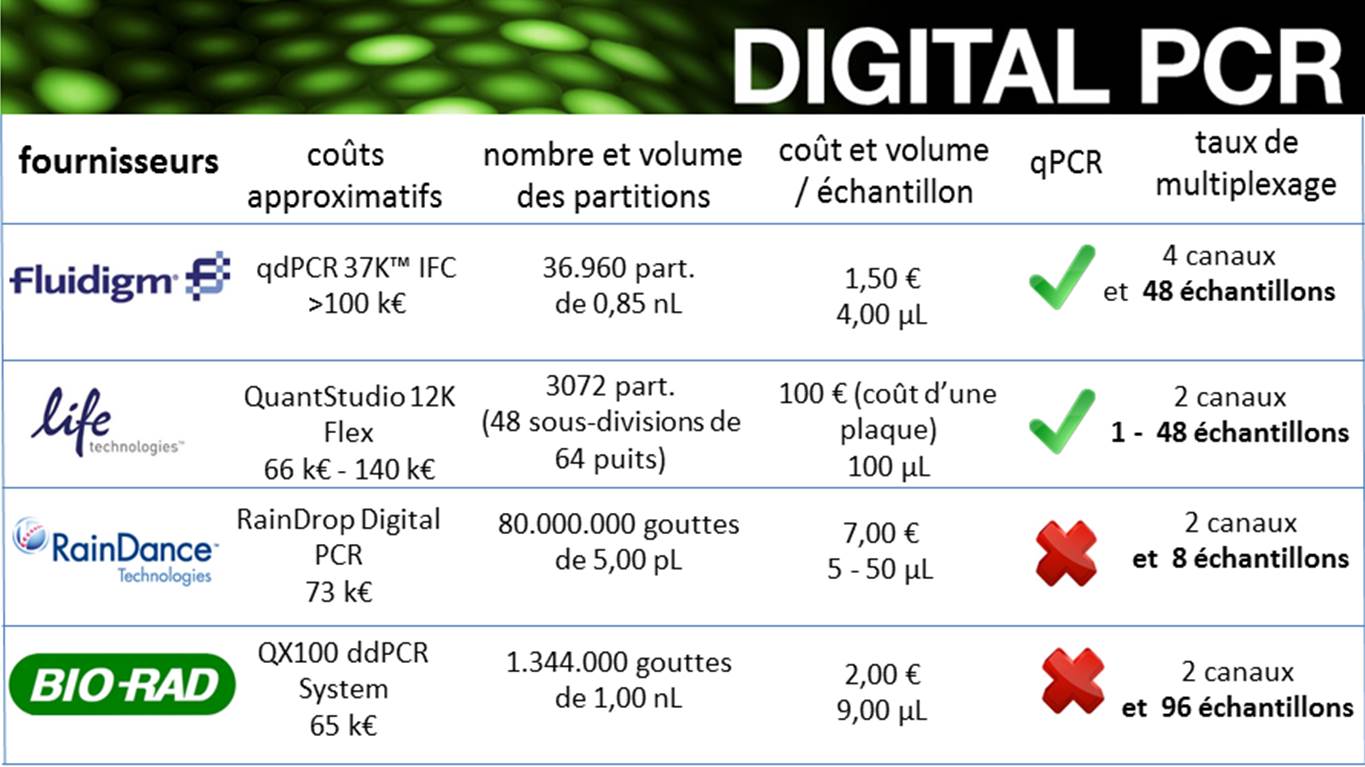

Actuellement, plusieurs fournisseurs proposent des plateformes aux spécifications très différentes. Les quatre fournisseurs ci-dessous proposent des systèmes de PCR numérique basés sur de la microfluidique pour Fluidigm, des interfaces solides (type OpenArray) de Life Technologies et des micro-gouttes pour Raindance et Biorad.

Ainsi, que le mentionne Jim Huggett (chef d’équipe au LGC), cité dans la publication de Monya Baker (Digital PCR hits its stride), la PCR numérique est réservée à des utilisateurs experts et se trouve encore allouée à des applications spécialisées car encore beaucoup plus chère que la PCR quantitative (traditionnelle) qui reste adaptée à la majorité des applications.

A l’aube des années 2000, la génomique appliquée au domaine végétal fait l’objet d’une mobilisation internationale de grande ampleur comme en témoignent les programmes « Zygia » et « Gabi » en Allemagne, « Plant Genome Initiative » aux États-Unis, ou encore « Rice Genome Research Program » au Japon, qui poursuivent des objectifs analogues. Il devient primordial d’identifier les gènes et leur fonction jouant notamment un rôle décisif dans la production végétal (Rusticité, résistance aux maladies, aux herbicides, etc…).

A l’aube des années 2000, la génomique appliquée au domaine végétal fait l’objet d’une mobilisation internationale de grande ampleur comme en témoignent les programmes « Zygia » et « Gabi » en Allemagne, « Plant Genome Initiative » aux États-Unis, ou encore « Rice Genome Research Program » au Japon, qui poursuivent des objectifs analogues. Il devient primordial d’identifier les gènes et leur fonction jouant notamment un rôle décisif dans la production végétal (Rusticité, résistance aux maladies, aux herbicides, etc…).

Cette période est également marquée par l’achèvement du séquençage du génome de la plante modèle Arabidopsis thaliana, étape majeure dans la recherche en biologie végétale.

Simultanément, des collections de mutants d’insertions (T-DNA) chez A. thaliana sont créés au sein de nombreux groupes (SALK, GABI-Kat, Syngenta, INRA Versailles, etc…), et elles émergent notamment au travers du projet « Genoplante« , programme fédérateur en génomique végétale (Groupement d’Intérêt Scientifique regroupant à la fois des organismes publics tel que l’INRA, CNRS, Cirad, IRD et de puissants partenaires privés tel que Biogemma, Rhône-Poulenc Santé végétale et animale et Bioplante). L’idée est donc d’utiliser ces banques de mutants comme outils pour la génomique fonctionnelle appliquée à la plante modèle.

A l’époque, les solutions proposées pour l’identification des positions d’insertion du T-DNA au sein du génome sont nombreuses ( « Tail-PCR », « Inverse PCR », « Kanamycin Rescue » ). Néanmoins, ces approches restent fastidieuses: En plus de présenter certaines étapes techniques limitantes, elles sont également très chronophages.

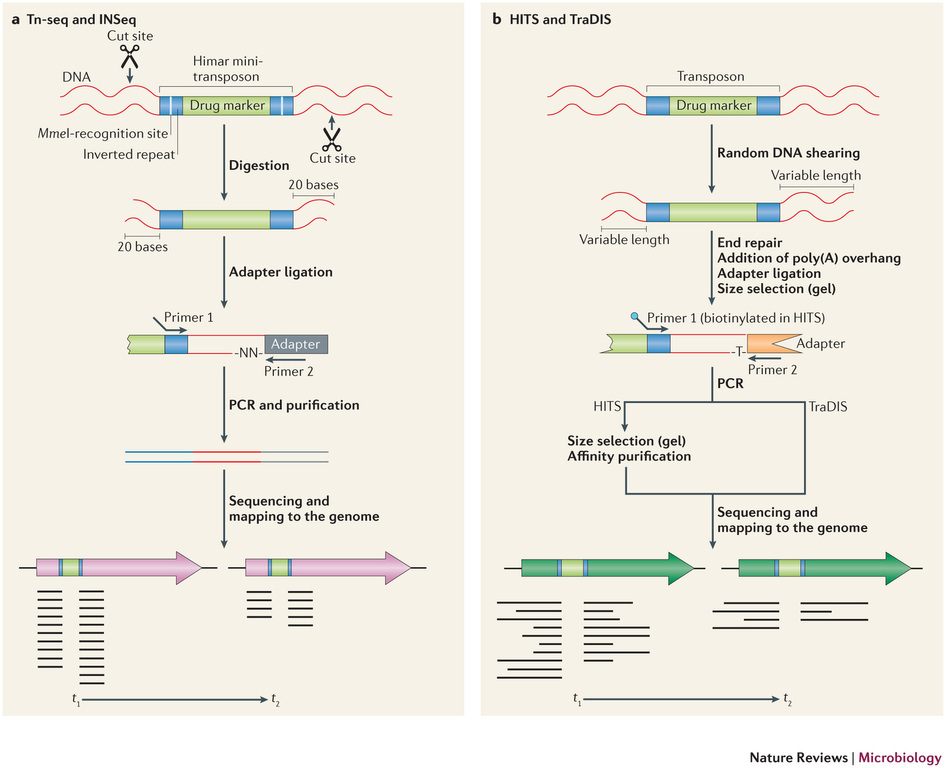

Récemment, de nombreuses études ont commencé a démontrer l’énorme potentiel du séquençage à haut-débit dans l’identification des sites d’insertion de transposons. Le terme générique « Tn-Seq », pour « Transposon-Sequencing », est une variante du séquençage d’amplicons ciblés (Target-seq) et peut se décliner selon quatre méthodes comme illustrées ci-dessous (Tim van Opijnen and Andrew Camilli, Nature reviews – Microbiology (2013 July)). Elles dépendent notamment de la procédure de préparation de librairie de séquençage employée:

– Le »Tn-seq » et « INSeq » (respectivement pour « Transposon sequencing » et « Insertion sequencing ») sont deux approches très similaires reposant sur un séquençage d’amplicons obtenus à partir d’un couple d’oligos dont l’un cible le transposon. Seule la méthode de purification varie (Gel PAGE pour « INSeq » et Gel agarose pour « Tn-Seq)

– Le « HITS » et « TraDIS » (respectivement pour « High-throughput insertion tracking by deep sequencing » et « Transposon-directed insertion site sequencing ») sont également deux méthodes très similaires notamment en amont de l’étape de PCR de librairie.

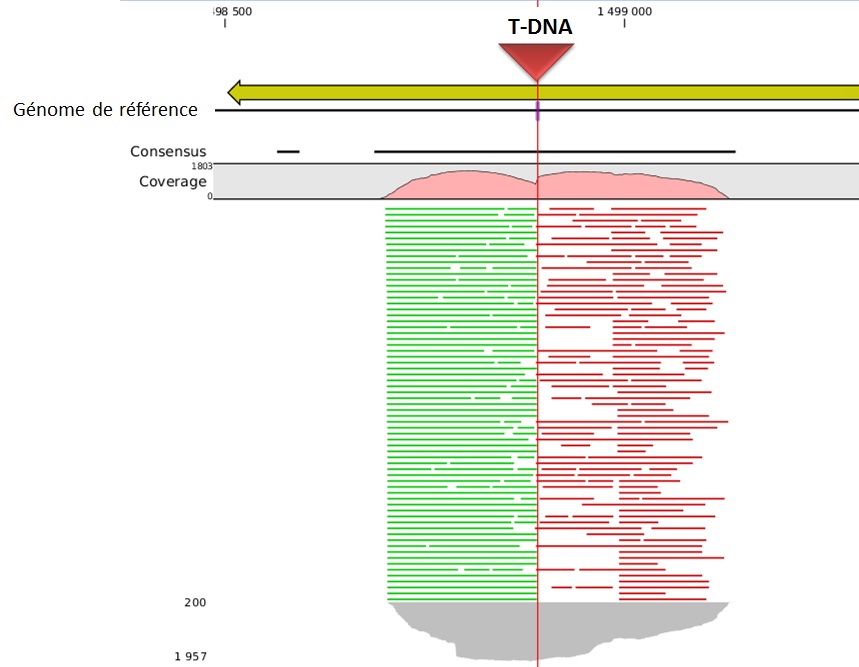

L’alignement des données de séquençage (.fastq) sur le génome de référence, permet ainsi d’identifier la position du site d’insertion. L’illustration met en évidence les « reads » issus de la PCR de librairie ciblant les régions flanquantes au Transposon (« En vert » la bordure gauche, « en rouge » la bordure droite). Sur la base de cette méthode, il devient donc aisé d’identifier le nombre d’insertion potentielle.

L’utilisation des technologies de séquençage à haut-débit pour l’identification des sites d’insertion de T-DNA dans les banques de mutants révolutionnent les méthodes de criblage. Tout en s’affranchissant de techniques fastidieuses, cette approche de Tn-seq présente à la fois l’avantage de pouvoir gérer simultanément un très grand nombre d’échantillons (barcoding), à des coûts réduits et dans un délai des plus respectables.

L’évolution des technologies de biologie moléculaire combinée à des systèmes de détection toujours plus sensibles, des techniques d’amplification accessibles dans des systèmes intégrés ont rendu possible l’analyse du transcriptome d’une cellule isolée. Dans de nombreux domaines tels que la cancérologie, la biologie des cellules souches, l’ingénierie des tissus, le signal moyen peut cacher la pertinence du signal noyé dans la masse des cellules d’intérêt.

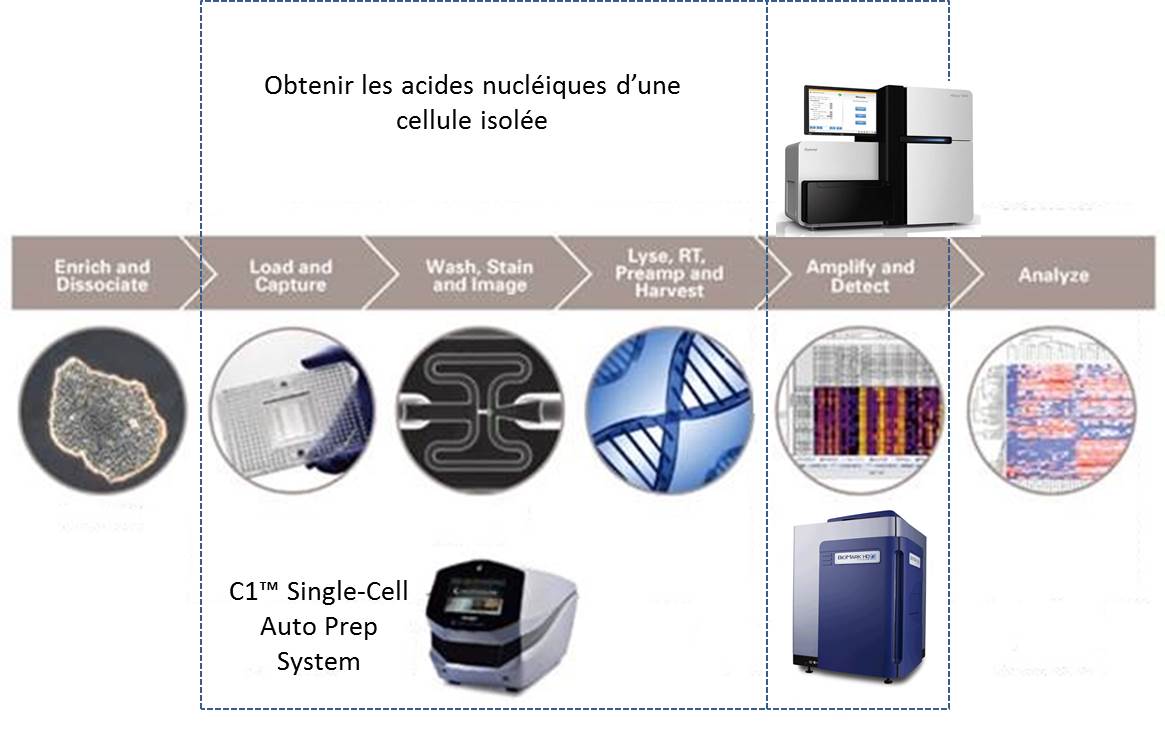

Défier la loi de la moyenne, en tenant compte de l’hétérogénéité cellulaire pour tenter de capter ce signal qui échappe aux systèmes n’analysant que le mélange de cellules, est le credo du système proposé par Fluidigm : le C1™ Single-Cell Auto Prep System.

Isoler des cellules pour extraire leur ARN peut être une tâche technique ardue consommatrice de temps et très sensible aux contaminations.

La société américaine, Fluidigm propose donc un système plutôt simple permettant de capturer quelques cellules pour en extraire leurs acides nucléiques. Le consommable est composé d’une plaque microfluidique comportant 96 pièges à cellules enchaînés. La multiplicité de ces pièges permet d’accroître les chances de capturer une cellule dans l’état escompté. Une fois la phase de capture accomplie, les divers pièges sont individualisés. Un système de by-pass permet de « pousser » chacune des cellules piégées dans une succession de « microréacteurs » isolés enchaînant phases de lyse, de transcription inverse, d’amplification des ARNs (WTA) et de collecte des acides nucléiques amplifiés.

Le schéma ci-dessous reprend les 2 phases principales permettant d’aboutir à l’analyse du transcriptome de cellules isolées :

(i) l’amplification d’ARN de cellules isolées

(ii) l’analyse de ces ARNs

Ainsi que le montre la vidéo promotionnelle ci-dessous le système est compact et se veut simple d’utilisation. Il va de soi, malgré tout, que pour optimiser vos chances de capturer un signal d’intérêt un marquage préalable cellules vivantes/mortes peut s’imposer. Ceci impose aussi d’observer la plaque microfluidique au microscope à fluorescence (en se hâtant quelque peu). Bien évidemment l’adjonction de marqueurs discriminants (anticorps couplés à un agent fluorescent) est la bienvenue.

Cette dernière vidéo aborde le « workflow » aboutissant à l’analyse du transcriptome monocellulaire par Biomark, il va de soi qu’il s’agit là d’une « suggestion de présentation » puisqu’il est possible d’analyser le transcriptome amplifié par le système C1™ Single-Cell Auto Prep System avec un grand nombre de systèmes de qPCR ou de séquençage haut-débit.

http://youtu.be/TF4NJRE4Xg4

L’analyse des biomarqueurs des cellules tumorales circulantes devient un élément majeur de la médecine personnalisée (lire L’enjeu des cellules tumorales circulantes). L’article d’Ashley A. Powell et al. (Single Cell Profiling of Circulating Tumor Cells: Transcriptional Heterogeneity and Diversity from Breast Cancer Cell Lines (Plos One, 2102)) montre l’application de ce système au niveau de l’analyse de « biopsie liquide« .

L’outil proposé par Fluidigm trouve d’ores et déjà des applications cliniques très concrètes : l’analyse de biomarqueurs des cellules tumorales circulantes à visée pronostique.

Qui sommes nous?

Christophe Audebert [@]

En charge de la plateforme génomique

du département recherche et développement

de la société Gènes Diffusion .

En charge de la plateforme génomique

du département recherche et développement

de la société Gènes Diffusion .

Renaud Blervaque [@]

Biologiste moléculaire, chargé d'études génomiques.

Biologiste moléculaire, chargé d'études génomiques.

Gaël Even [@]

Responsable bioinformatique au sein

du département recherche et développement de la société Gènes Diffusion.

Responsable bioinformatique au sein

du département recherche et développement de la société Gènes Diffusion.

Catégories

- Analyse de données (14)

- Automatisation (5)

- Bioinformatique (27)

- Biologie (56)

- biologie transverse (35)

- Biotechnologie (30)

- Chronique littéraire (8)

- Comparatif (6)

- Diagnostic (8)

- Economie (17)

- Epidemiologie (2)

- Evénement (17)

- Formation (3)

- Gestion de projet (5)

- Grille de calcul (1)

- Intégration (5)

- Logiciels (8)

- Médecine (14)

- politique de la recherche (17)

- Recherche (21)

- Séquençage (70)

- Séquenceur (39)

- Uncategorized (25)

- Workflow (4)

Accès rapide aux articles

- Covid-19 : zoom sur les vaccins

- Comment l’ADN pourrait être le stockage de données du futur

- COVID-19 : la data visualisation au service de la science

- COVID-19 : des explications et un point d’étape au 20 février 2020

- Pour mettre du vin dans son eau

- Des petits trous, toujours des petits trous…

- Qui serait candidat ?

- Un robot pour analyser vos données…

- Monde de dingue(s)

- L’art et la manière de développer une qPCR

- Un MOOC Coursera sur le WGS bactérien

- Chercheurs & enseignants-chercheurs, l’art du multitâche.

- Un jeu de données métagénomiques

- Facteur d’impact

- Microbiote & smart city : juxtaposition de tendances

Accès mensuels

- février 2021 (1)

- décembre 2020 (1)

- février 2020 (2)

- septembre 2019 (1)

- avril 2018 (2)

- décembre 2017 (1)

- novembre 2017 (2)

- juillet 2017 (2)

- juin 2017 (5)

- mai 2017 (4)

- avril 2017 (3)

- mars 2017 (1)

- janvier 2017 (2)

- décembre 2016 (3)

- novembre 2016 (4)

- octobre 2016 (2)

- septembre 2016 (2)

- août 2016 (3)

- juillet 2016 (2)

- juin 2016 (4)

- mai 2016 (3)

- mars 2016 (1)

- novembre 2015 (2)

- avril 2015 (1)

- novembre 2014 (1)

- septembre 2014 (1)

- juillet 2014 (1)

- juin 2014 (1)

- mai 2014 (1)

- avril 2014 (1)

- mars 2014 (1)

- février 2014 (3)

- janvier 2014 (1)

- décembre 2013 (5)

- novembre 2013 (2)

- octobre 2013 (2)

- septembre 2013 (1)

- juillet 2013 (2)

- juin 2013 (2)

- mai 2013 (4)

- avril 2013 (2)

- mars 2013 (1)

- février 2013 (3)

- janvier 2013 (2)

- décembre 2012 (2)

- novembre 2012 (2)

- octobre 2012 (2)

- septembre 2012 (2)

- août 2012 (1)

- juillet 2012 (3)

- juin 2012 (5)

- mai 2012 (5)

- avril 2012 (6)

- mars 2012 (6)

- février 2012 (8)

- janvier 2012 (6)

- décembre 2011 (5)

- novembre 2011 (6)

- octobre 2011 (6)

- septembre 2011 (7)

- août 2011 (5)

- juillet 2011 (8)

Pages