En cancérologie, l’allogreffe de moelle osseuse s’inscrit dans un parcours thérapeutique notamment comme traitement de consolidation après une chimiothérapie. Aussitôt, les notions de rejet ou d’acceptation du greffon apparaissent et il devient indispensable que les systèmes HLA (Human Leucocyt Antigens, découvert en 1950) du donneur et du receveur soient les plus proches possibles.

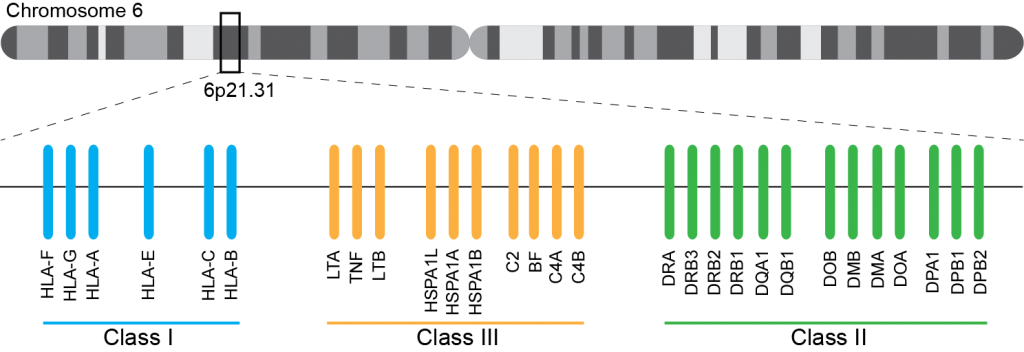

Ce système immunogène, situé sur le bras court du chromosome 6 chez l’homme, est caractérisé par son polygénisme et son polymorphisme qui sont à l’origine d’une grande variabilité interindividuelle et en fait le déterminant principal du résultat de greffe. L’ensemble des gènes HLA sont subdivisés en trois régions du chromosome 6 qui contiennent chacune de nombreux gènes avec ou sans fonction immunologique. On distingue ainsi la région CMH de classe I, de classe II, et de classe III.

A ce jour, un rendu de typage est ciblé sur une portion génomique restreinte codant pour le HLA. Il s’agit de l’exon 2 et 3 des loci HLA-A, HLA-B et HLA-C (région I), l’exon 2 et 3 des loci HLA-DQ (DQ-A et DQ-B) et l’exon 2 pour HLA-DR (DRA et DRB1), où repose prés de 70% du polymorphisme. La région III ne renfermant pas de gènes intervenant dans la présentation antigénique.

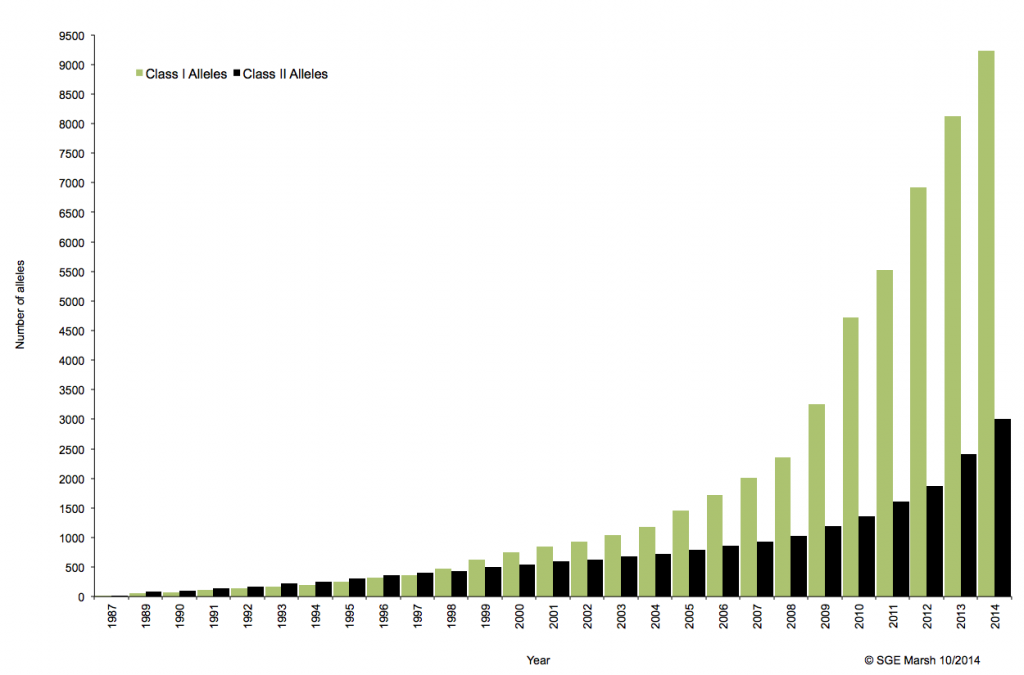

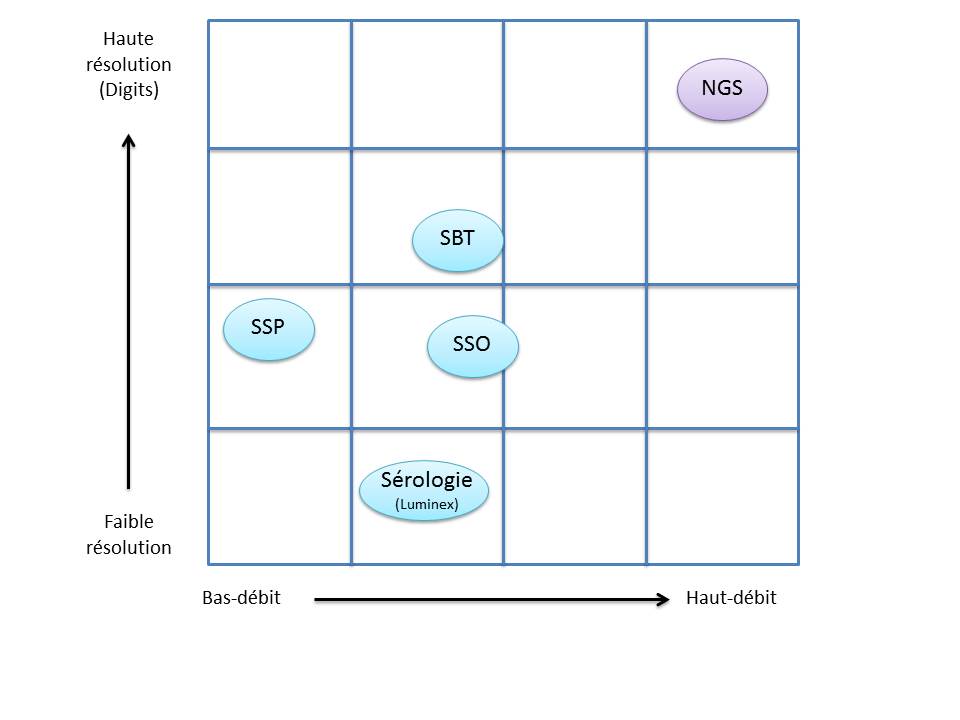

C’est ainsi que différentes approches de typages ont été développées et l’avènement de la technique de PCR au milieu des années 1980 a pallié aux limites de résolution de la sérologie employée jusqu’alors. D’un typage rendu au niveau générique (2 Digits), la « PCR-SSO » (Sequence Specific Oligonucleotide) et la « PCR-SSP » (Sequence Specific Primer) développées dans les années 1990 ont permis d’accéder à un résultat allélique (4 Digits). Cette avancée technologique s’est poursuivie la décennie suivante avec la « PCR-SBT » (Sequence Based Typing) ou séquençage « Sanger » puis plus récemment avec la PCR en temps réel (ex: linkage). Toutes ces techniques de biologie moléculaire ont permis de mettre en avant le polymorphisme et la grande diversité génétique du HLA. Chaque année, de nombreux allèles sont découverts, alimentant continuellement la banque de données de référence IMGT.

Associé à cette augmentation constante du nombre d’allèles typés, le nombre d’ambigüités croît et met progressivement en difficulté les technologies conventionnelles qui atteignent leurs limites. De plus, le pourcentage de réussite des allogreffes n’atteint environ que 50%. L’exploitation du reste de l’information génomique permettrait potentiellement d’améliorer cette performance par un typage plus affiné.

Le recours au séquençage nouvelle génération apparait donc inévitable. En plus de gérer les ambiguïtés par un séquençage allélique, le NGS permet de traiter simultanément de grandes quantités d’échantillons réduisant ainsi le coût unitaire, d’accéder à un niveau de résolution supérieur (4,6 ou 8 digits) tout en ayant la capacité de cibler des loci entier (Long Range PCR).

Ainsi, plusieurs stratégies existent avec leur solution technique adaptée à la préparation de la matrice d’ADN à séquencer:

– L’amplification ciblée des régions d’intérêt par PCR de fusion. Cette approche permets un gain de temps et une réduction des coûts en s’affranchissant des étapes de fragmentation, ligation, et autres purifications… .Par ailleurs elle n’est pas la mieux adapté dans le cas d’une couverture de séquençage de l’ensemble de la région génomique HLA.

– L’amplification par « Long Range PCR » permet une couverture complète des différents loci étudiés. Les fragments de plusieurs Kb subissent alors une fragmentation, une ligation des adaptateurs et indexation. Cette approche permet d’accéder à davantage d’informations (régions exoniques et introniques).

– La capture de séquences par hybridation. Même si cette solution est bien caractérisée elle n’est pas si efficace en terme de capture avec une disparité selon la taille des fragments.

– Le séquençage de génome entier ou d’exome. Cette approche est la moins biaisée et couvre tous les gènes du système HLA. Paradoxalement, l’analyse nécessite beaucoup trop de ressources pour une utilisation en routine et ne permets pas de traiter autant d’échantillons simultanément.

Plusieurs sociétés commerciales proposent des solutions clé en main depuis la préparation des échantillons (avec l’option « Long Range PCR » qui semble la plus plébiscité) jusqu’à l’analyse de résultats via leur logiciel dédié. Certaines sont en cours de validation de méthode pendant que d’autres tentent d’inonder le marché. Parmi elles, Gendx, Omixon, Illumina, One lambda, Life technologies, Immucor, etc…

L’exploitation des capacités et caractéristiques des solutions de séquençage à haut-débit permettrait d’affiner considérablement le typage HLA. Ainsi le décryptage de l’ensemble des régions codantes et non-codantes du génome d’intérêt représente un enjeu important dans la réussite des greffes. Par ailleurs, cette approche nécessitera une mise à jour considérable des banques de données (IMGT) avec une validation de nombreux nouveaux allèles.

Au cours des dix dernières années, la génomique connait une avancée technologique indéniable au travers des différents procédés de séquençage à haut-débit de deuxième génération. Néanmoins, certaines limites techniques subsistent, notamment par rapport à la quantité d’ADN requit, impliquant donc son extraction à partir de plusieurs millions de cellules. Cette contrainte implique une dilution de l’information pour des cellules aux fonctions biologiques bien souvent hétérogènes jusqu’au sein d’un même tissu.

En attendant la démocratisation du séquençage de troisième génération (Séquençage ADN sans amplification clonale) aux caractéristiques techniques qui permettraient un virage vers la génomique à l’échelle de la cellule unique , des méthodes alternatives appliquées à la seconde génération se développent afin d’accéder à cette hétérogénéité cellulaire. Ces solutions s’accompagnent donc, en amont du séquençage, d’une inévitable amplification de l’ADN de la cellule, préalablement isolée soit microdissection laser, système de microfluidique (ex: C1 Fluidigm), cytométrie en flux, ou encore micropipettage.

Ce poste est donc l’occasion de présenter la méthode d’amplification MALBAC, pour Multiple Annealing and Looping Based Amplification Cycles (Science, Zong et al.).

La méthode MALBAC repose sur l’utilisation de primers spécifiques (séquence de 8 nucléotides variables s’hybridant aléatoirement sur l’échantillon, couplée à une séquence connue de 26 nucléotides) générant des amplicons aux extrémités complémentaires. Cette particularité favorise la formation d’une boucle, évitant ainsi aux brins néo-synthétisés de servir à nouveau de matrice à la PCR et d’engendrer un biais d’ amplification (contrairement à la MDA). Ces étapes d’amplifications quasi-linéaires sont répétées cinq fois, puis les amplicons sont amplifiés par PCR exponentielle classique, en amont du séquençage.

MALBAC favorise une meilleure couverture de séquençage ainsi qu’une amplification plus uniforme (cf représentation ci-dessous) . De par ses performances, elle surclasse les méthodes conventionnelles tel que PEP-PCR, DOP-PCR ou encore MDA, pour Multiple Displacement Amplification, méthode la plus répandue depuis dix ans. Jusqu’à 83% de couverture à 10X de profondeur contre 45% pour la MDA. Parmi les autres atouts, la quantité d’ADN initiale requise n’est que de 0.5pg (contre 1000pg pour la MDA) et la polymérase Bst associée connait un taux d’erreur de 1/10000 bases.

Les performances de cette méthode permettent ainsi de reconsidérer les études génomiques ciblant un matériel biologique rare. Parmi elles, l’analyse de cellules tumorales circulantes, de tissus microdisséqués, de cellules embryonnaires, de micro-organismes, de cellules foetales circulantes, , etc…

Le développement des technologies à haut-débit dédiés aux petits ARNs non codant, récemment identifiés (fin des années 90), voit régulièrement déferler des solutions commerciales et libres pour l’analyse gene ontology.

La puissance de cet outils réside dans:

2) l’incorporation de deux algorithmes pour la caractérisation des fonctions biologiques et pathways sur la base de la prédiction des gènes cibles et faisant appel à cinq bases de données (KEGG, Biocarta, PID, Reactome et Gene Ontology – cf fig. ci-dessous, rectangle orange).

Citation

PLoS One. 2012;7(8):e42390. doi: 10.1371/journal.pone.0042390. Epub 2012 Aug 1.

miRSystem: an integrated system for characterizing enriched functions and pathways of microRNA targets.

Lu TP1, Lee CY, Tsai MH, Chiu YC, Hsiao CK, Lai LC, Chuang EY.

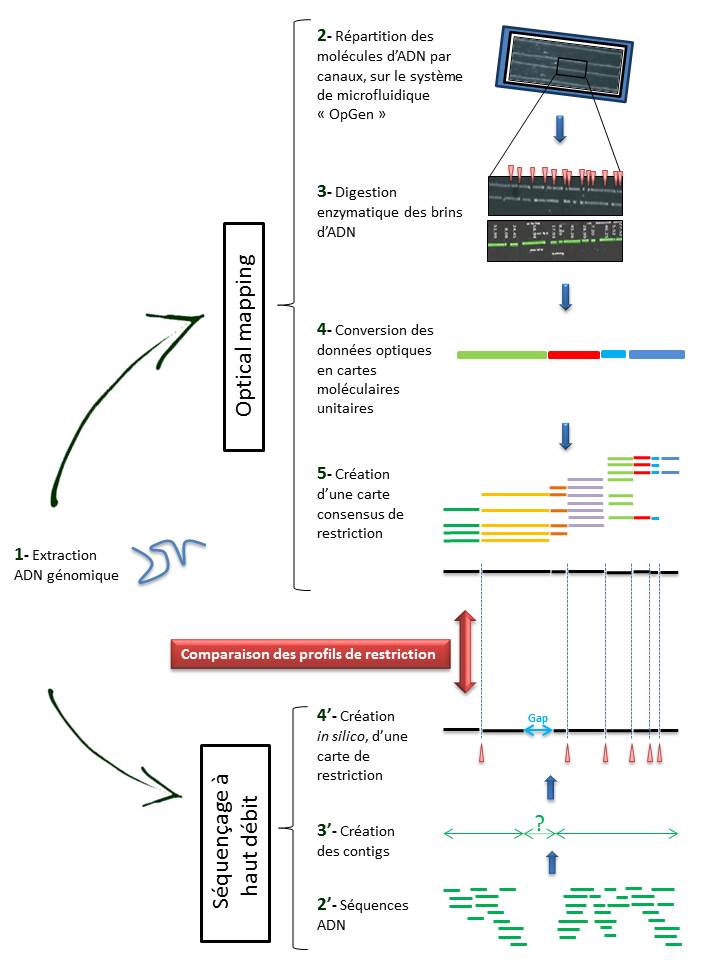

Parmi les technologies dédiées à la génomique, l’ « Optical Mapping » fait figure d’outil qualifiable d’alternatif. Cette approche repose sur une représentation graphique des sites de restrictions enzymatiques au travers d’un génome complet.

Parmi les technologies dédiées à la génomique, l’ « Optical Mapping » fait figure d’outil qualifiable d’alternatif. Cette approche repose sur une représentation graphique des sites de restrictions enzymatiques au travers d’un génome complet.

Les applications concernent aussi bien la génomique comparative (détection des délétions, insertions, inversions ou translocations), que le typage de souches (comparaison des cartes de restrictions). Aussi, conjuguée aux technologies de séquençage à haut-débit, elle permet également de répondre aux illusions fréquentes de l’obtention d’un « draft » de génome d’intérêt, nouvellement séquencé. Actuellement, OpGEN est la seule société proposant une solution semi-automatisée de cette technologie.

Techniquement, l’ « Optical mapping » consiste en (Cf fig ci-dessous):

– Une immobilisation des fragments d’ADN génomique extraits (1) au sein de canaux intégrés dans un support dédié (Argus System – OpGen) (2).

– Chaque molécule subit une digestion enzymatique (endonucléase de restriction) générant des sites de clivage, symbolisés ci dessous par les espaces (3).

– Le logiciel d’analyse (MapSolver) convertit ces données optiques en cartes moléculaires unitaires (4), qui alignées, fournissent une carte de restriction consensus du génome étudié (5).

L’utilisation de cette méthode, dans la perspective d’un assemblage efficace de génome, ne cesse de croître. En effet, elle permet de pallier les limites des NGS (Homopolymères, zones de génome peu ou non couvert) qui ne permettent bien souvent d’aboutir qu’à un nombre restreint de contigs (3′).

Il convient alors de créer une carte de restriction, in silico, de ces contigs (4′), à leur tour alignés sur l’ « optical map » du génome, sur la base des sites de clivage. Cette comparaison permet alors de positionner les contigs entre eux, de les orienter et de mettre en lumière les hypothétiques gaps. Le scaffold des contigs ainsi établi, associé à un séquençage Sanger des gaps permettent ainsi d’aboutir à un « draft » du génome étudié.

L’ « optical mapping » apparait comme un outil fiable et utile dans l’assemblage de génome, d’autant qu’il fait appel à une technique différente, indépendante mais à la fois très complémentaire au séquençage à haut débit.

A l’aube des années 2000, la génomique appliquée au domaine végétal fait l’objet d’une mobilisation internationale de grande ampleur comme en témoignent les programmes « Zygia » et « Gabi » en Allemagne, « Plant Genome Initiative » aux États-Unis, ou encore « Rice Genome Research Program » au Japon, qui poursuivent des objectifs analogues. Il devient primordial d’identifier les gènes et leur fonction jouant notamment un rôle décisif dans la production végétal (Rusticité, résistance aux maladies, aux herbicides, etc…).

A l’aube des années 2000, la génomique appliquée au domaine végétal fait l’objet d’une mobilisation internationale de grande ampleur comme en témoignent les programmes « Zygia » et « Gabi » en Allemagne, « Plant Genome Initiative » aux États-Unis, ou encore « Rice Genome Research Program » au Japon, qui poursuivent des objectifs analogues. Il devient primordial d’identifier les gènes et leur fonction jouant notamment un rôle décisif dans la production végétal (Rusticité, résistance aux maladies, aux herbicides, etc…).

Cette période est également marquée par l’achèvement du séquençage du génome de la plante modèle Arabidopsis thaliana, étape majeure dans la recherche en biologie végétale.

Simultanément, des collections de mutants d’insertions (T-DNA) chez A. thaliana sont créés au sein de nombreux groupes (SALK, GABI-Kat, Syngenta, INRA Versailles, etc…), et elles émergent notamment au travers du projet « Genoplante« , programme fédérateur en génomique végétale (Groupement d’Intérêt Scientifique regroupant à la fois des organismes publics tel que l’INRA, CNRS, Cirad, IRD et de puissants partenaires privés tel que Biogemma, Rhône-Poulenc Santé végétale et animale et Bioplante). L’idée est donc d’utiliser ces banques de mutants comme outils pour la génomique fonctionnelle appliquée à la plante modèle.

A l’époque, les solutions proposées pour l’identification des positions d’insertion du T-DNA au sein du génome sont nombreuses ( « Tail-PCR », « Inverse PCR », « Kanamycin Rescue » ). Néanmoins, ces approches restent fastidieuses: En plus de présenter certaines étapes techniques limitantes, elles sont également très chronophages.

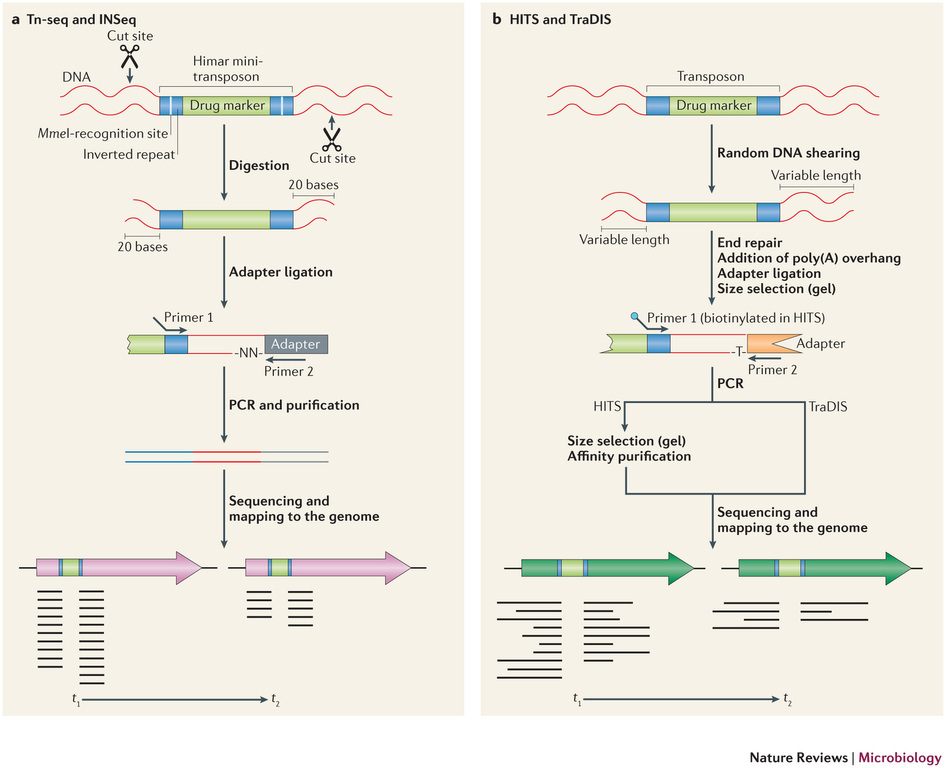

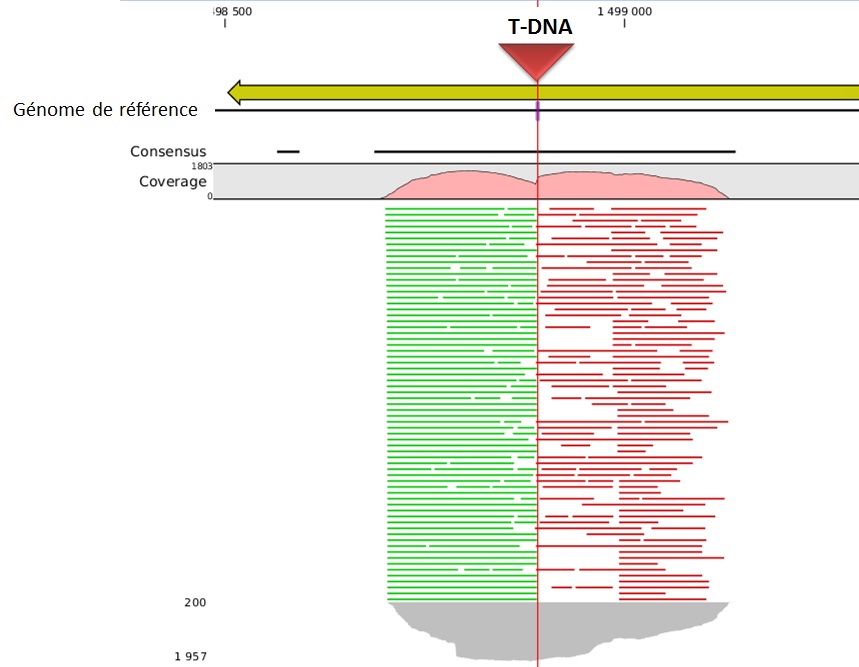

Récemment, de nombreuses études ont commencé a démontrer l’énorme potentiel du séquençage à haut-débit dans l’identification des sites d’insertion de transposons. Le terme générique « Tn-Seq », pour « Transposon-Sequencing », est une variante du séquençage d’amplicons ciblés (Target-seq) et peut se décliner selon quatre méthodes comme illustrées ci-dessous (Tim van Opijnen and Andrew Camilli, Nature reviews – Microbiology (2013 July)). Elles dépendent notamment de la procédure de préparation de librairie de séquençage employée:

– Le »Tn-seq » et « INSeq » (respectivement pour « Transposon sequencing » et « Insertion sequencing ») sont deux approches très similaires reposant sur un séquençage d’amplicons obtenus à partir d’un couple d’oligos dont l’un cible le transposon. Seule la méthode de purification varie (Gel PAGE pour « INSeq » et Gel agarose pour « Tn-Seq)

– Le « HITS » et « TraDIS » (respectivement pour « High-throughput insertion tracking by deep sequencing » et « Transposon-directed insertion site sequencing ») sont également deux méthodes très similaires notamment en amont de l’étape de PCR de librairie.

L’alignement des données de séquençage (.fastq) sur le génome de référence, permet ainsi d’identifier la position du site d’insertion. L’illustration met en évidence les « reads » issus de la PCR de librairie ciblant les régions flanquantes au Transposon (« En vert » la bordure gauche, « en rouge » la bordure droite). Sur la base de cette méthode, il devient donc aisé d’identifier le nombre d’insertion potentielle.

L’utilisation des technologies de séquençage à haut-débit pour l’identification des sites d’insertion de T-DNA dans les banques de mutants révolutionnent les méthodes de criblage. Tout en s’affranchissant de techniques fastidieuses, cette approche de Tn-seq présente à la fois l’avantage de pouvoir gérer simultanément un très grand nombre d’échantillons (barcoding), à des coûts réduits et dans un délai des plus respectables.

Le séquençage du génome humain pour 30$, c’est la promesse faite par David Weitz, co-fondateur de GnuBio au cours de l’année 2010. Trois ans plus tard, la start-up vient de lancer en béta-test son nouveau procédé de séquençage à haut débit. Il s’agit du premier système entièrement intégré (amplification des cibles, enrichissement, séquençage et analyse) qui propose pour le moment une application de target-sequencing destinée aux cliniciens et dédiée au diagnostic moléculaire.

Le séquençage du génome humain pour 30$, c’est la promesse faite par David Weitz, co-fondateur de GnuBio au cours de l’année 2010. Trois ans plus tard, la start-up vient de lancer en béta-test son nouveau procédé de séquençage à haut débit. Il s’agit du premier système entièrement intégré (amplification des cibles, enrichissement, séquençage et analyse) qui propose pour le moment une application de target-sequencing destinée aux cliniciens et dédiée au diagnostic moléculaire.

En 2010, David Weitz et son équipe de l’Université d’Harvard ambitionnent de développer une nouvelle technologie de séquençage à haut-débit, alliant les technologies de biologie moléculaire aux procédés de microfluidique développés quelques années plus tôt (2004) au sein de la société RainDance technologies.

Cette nouvelle approche repose sur la capacité à générer des gouttes de l’ordre du picolitre et pouvant être déplacée sur une puce microfluidique. Ces gouttes peuvent renfermer soit un couple d’amorces, des adaptateurs, ou tout autre type de réactifs nécessaires aux étapes de préparation de librairie et de séquençage (séquençage par hybridation-ligation, type SOLiD avec une fidélité de 99.99%). Dès lors, leurs quantités utilisées au sein de ces picogouttes sont considérablement revues à la baisse, ce qui constitue le point clé à une réduction des coûts de séquençage et donc la perspective d’un séquençage de génome humain à 30$, selon David Weitz.

Les projets de GnuBio sont désormais d’élargir le champs d’applications de leur séquenceur à l’analyse transcriptomique (RNA-seq), l’étude de la méthylation (ChiP-seq) ou encore le séquençage de génome entier. La société ambitionne une commercialisation de leur équipement au cours de l’année 2014.

A suivre…

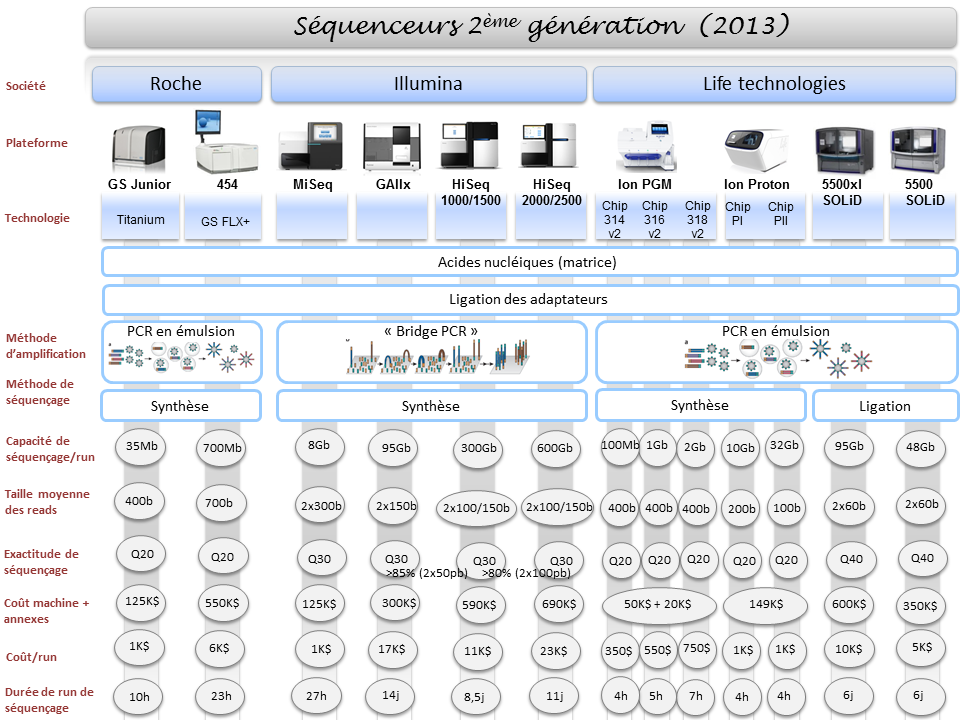

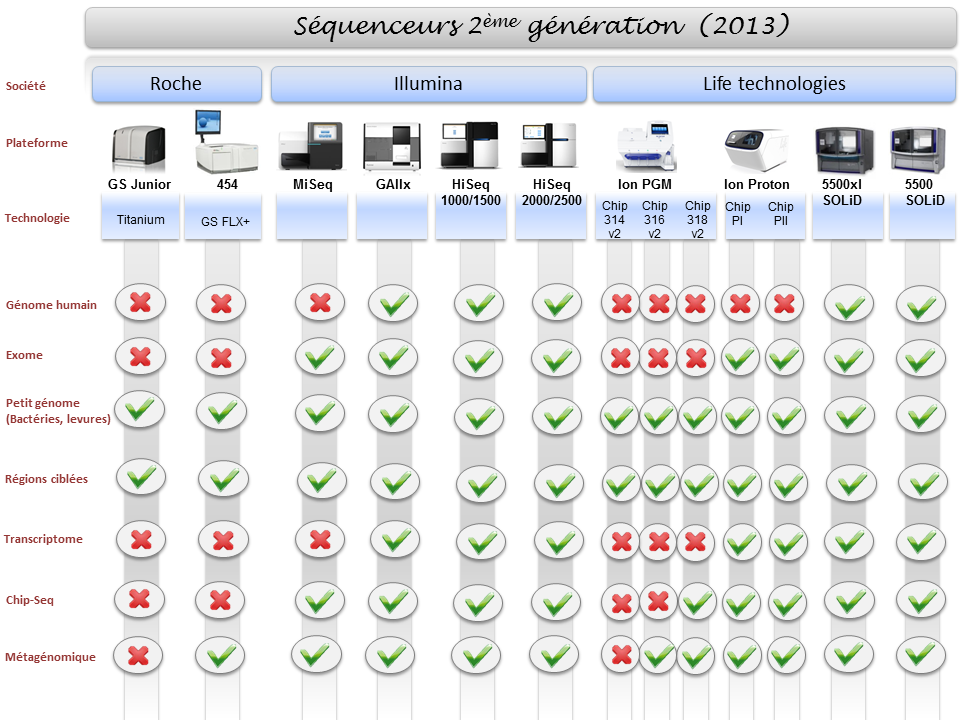

La diversité du parc technologique des séquenceurs de deuxième génération n’est plus une surprise pour personne. Ceci étant, il devenait indispensable de mettre à jour l’ensemble des informations postées sur ce site, il y a exactement deux ans (2011), faisant un état de l’art des différentes caractéristiques technologiques des séquenceurs, ainsi que les possibles applications biologiques associées.

Pour ne mentionner que les trois plus gros fournisseurs du marché, les sociétés Roche, Illumina et Life Technologies n’ont cessé de faire évoluer leur gamme, tant sur le plan des équipements que sur le plan des capacités de séquençage.

Par voie de conséquence, ce survol est l’occasion de refaire le point sur les technologies appropriées selon l’application biologique recherchée. A noter que le Ion proton, dernier en date sur le marché des séquenceurs de deuxième génération disposera au cours de l’année 2014 d’une puce « PIII » permettant de générer environ 64Gb. Cette capacité de séquençage permettra à Ion torrent de se positionner sur le séquençage de génome humain à partir d’un séquenceur de paillasse et accèdera ainsi à la gamme complète des applications citées ci-dessous.

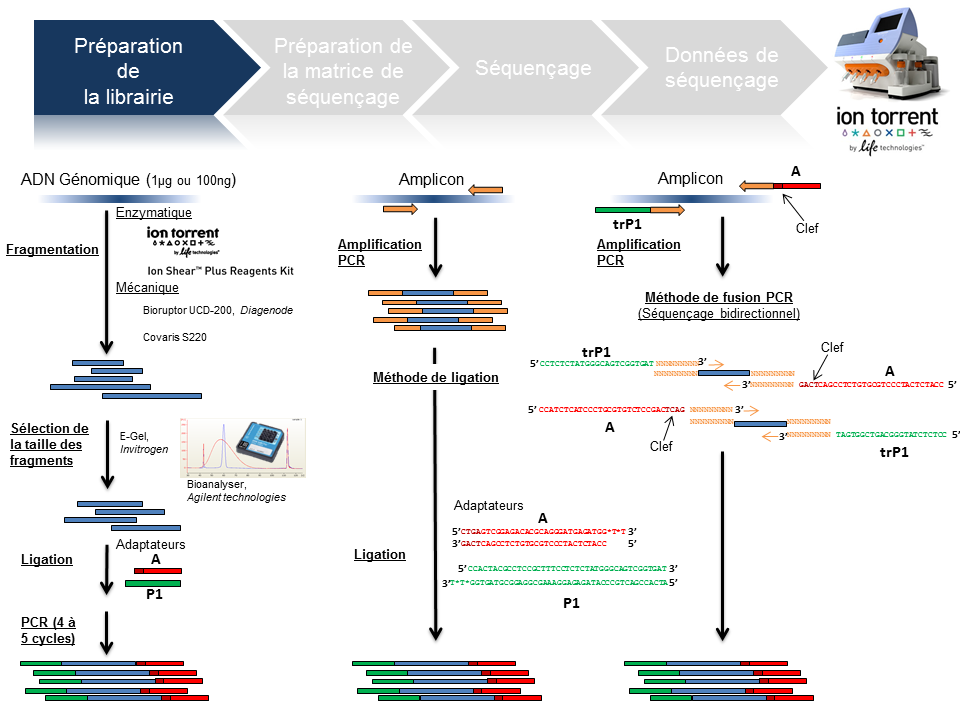

Ce poste a vocation de passer en revue les différentes étapes de la technologie de séquençage à haut-débit du PGM Ion Torrent, depuis la préparation de la librairie jusqu’à l’obtention des données brutes. Ce survol technologique permet de rassembler un maximum d’explications techniques et de termes clefs associés à cette technologie. L’intérêt est de répondre essentiellement à une attente de néophytes ou futurs utilisateurs du PGM friands de retours d’expériences.

L’arbre de décision Ion Torrent s’étant considérablement développé, seuls les axes « Whole genome » et « Amplicon » serviront de support à l’ensemble de la présentation.

Préparation de la librairie

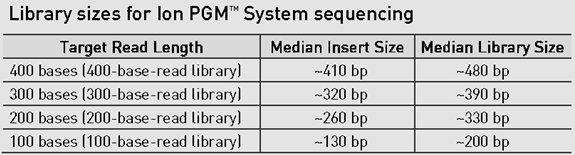

La finalité d’une préparation de librairie pour le PGM Ion Torrent est de lier aux fragments d’ADN à séquencer le couple d’adaptateurs A et P1. La taille médiane des fragments est variable et définie selon la chimie employée: 100, 200 , 300 ou 400 bases (Cf tableau ci-dessous).

Le traitement d’un échantillon d’ADN génomique débute par une étape de fragmentation mécanique ou enzymatique. Cette dernière présente l’avantage d’être considérablement plus rapide.

En amplicon-seq, la méthode pour flanquer les adaptateurs est double, par ligation ou par fusion PCR.

Par ailleurs, il est envisageable de traiter plusieurs échantillons en parallèle en utilisant des adaptateurs avec code barre ( En standard chez Life technologies: Au nombre de 96 pour les échantillons ADN et 16 pour les échantillons ARN).

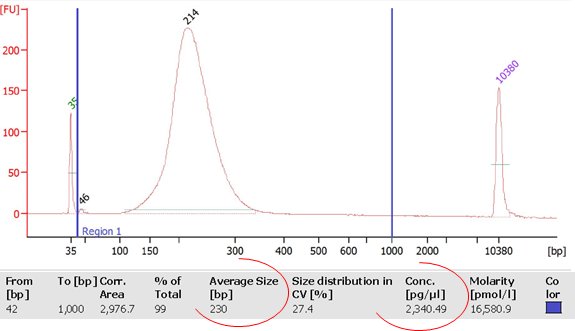

La librairie est monitorée sur puce DNA High sensitivity (Bioanalyzer, Agilent) avec comme objectifs de calculer sa concentration et d’identifier la taille moyenne des fragments qui la composent. Ces valeurs permettront ainsi de déterminer la concentration molaire de la libairie et d’y appliquer le facteur de dilution nécessaire pour favoriser le ratio idéal 1/1 (Fragment ADN de la librairie/Ion Sphere Particle) pour l’étape suivante de PCR en émulsion.

Préparation de la matrice de séquençage

Cette étape automatisée permet l’amplification clonale (OneTouch2) suivi d’un enrichissement en « Ion Sphere Particles » (ISPs) à la surface desquelles un fragment de librairie est amplifié (OneTouch ES).

L’amplification clonale est réalisée au cours de la PCR en émulsion (emPCR) et contribuera à atteindre un seuil de détection du signal nécessaire et suffisant au moment du séquençage. Malgré une optimisation du ratio 1/1 (ISP / Fragment ADN), plusieurs configurations de microréacteurs sont envisageables. Seule la configuration de monoclonalité est souhaitée car elle seule, est source de données de séquençage. Les autres configurations généreront des données qui seront filtrées lors de la primo-analyse par la « Torrent suite ».

L’amorce ePCR-A couplée à la biotine permettra l’enrichissement ultérieure par un système de capture sur billes liées à la streptavidine.

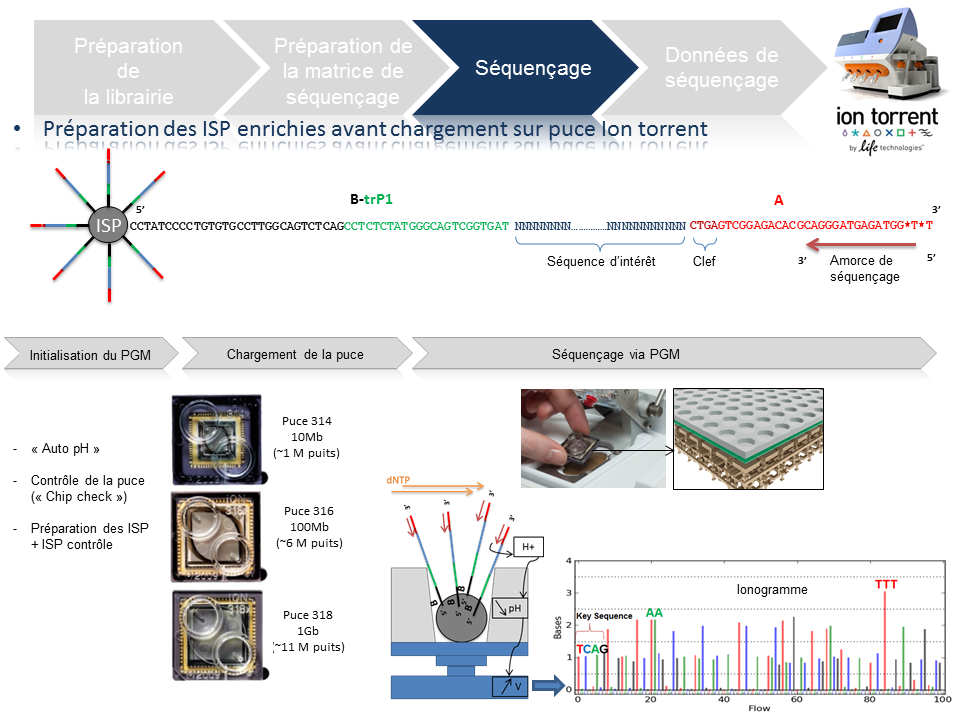

Séquençage

En amont de l’étape de séquençage, une initialisation du PGM est requise et permet notamment une homogénéisation des valeurs de pH ~ 7,8 au sein des différents réactifs de l’appareil (« Auto pH« ).

La matrice de séquençage couplée aux amorces de séquençage et à la polymérase est chargée sur la puce Ion Torrent selon un protocole bien spécifique. Les puces se déclinent selon 3 capacités de séquençage ( Chip 314 >10Mb, Chip 316 >100Mb, Chip 318 >1Gb). A noter qu’une version « v2 » pour chacune des puces précitées existe et est indispensable pour toute application de séquençage nécessitant la chimie 400. Le séquençage multiparallélisé revient donc au décryptage simultané des fragments ADN couplés aux ISP. A chaque polymérisation de nucléotides non modifiés, la libération d’ ions H+ entraine une variation de pH, elle même détectée au niveau de la couche mince (technologie des semi-conducteurs) située au fond de chaque puits. L’ensemble des données brutes générées est transcrits sous forme de ionogrammes.

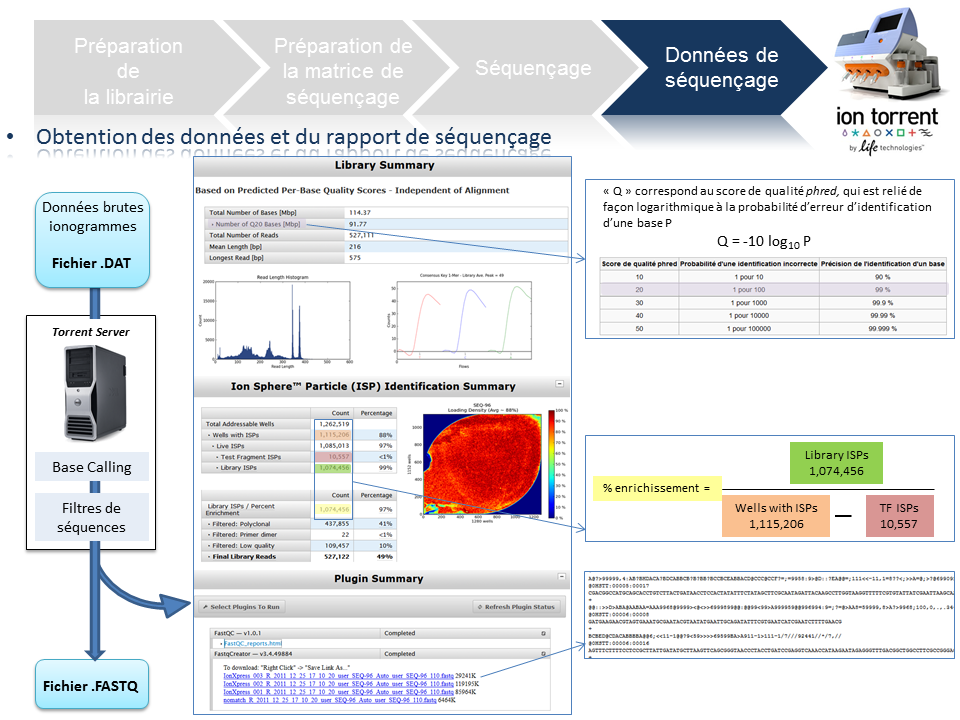

Données de séquençage

A l’issue du « run » de séquençage, le fichier .DAT regroupe l’ensemble des données brutes (ionogrammes). Ces fichiers sont transférés du PGM vers le Torrent Server. L’algorithme de « base calling » permet la conversion des données sous forme de lettres en séquences (A,T,C,G) formant le read (séquence au format fasta) associé à un score de qualité (Phred Score codé en ASCII), les deux types de données étant associés dans un fichier .FASTQ (qui tend à devenir le format de référence).

Un prétraitement est également appliqué sur la base des reads générés et qui équivaut au nombre d’ISPs vivantes ou « Live ISPs » (On parle d’ISPs vivantes pour les ISPs associées à la clef):

– trimming : élimination des adaptateurs et/ou portions de reads de mauvaise qualité

– filtres : élimination des « reads » de petites tailles, de mauvaise qualité, des polyclonaux

L’ensemble de ces informations est repris au travers du « report » généré à l’issue du séquençage et du prétraitement. Y sont également renseignés, le nombre de reads générés ainsi que leur taille moyenne.

L’accélération du débit bibliographique faisant référence aux « miRNA » atteste aisément de leur caractérisation récente (Lee RC et al., Cell (1993)) et de l’intérêt lié à leurs potentielles fonctions .

L’accélération du débit bibliographique faisant référence aux « miRNA » atteste aisément de leur caractérisation récente (Lee RC et al., Cell (1993)) et de l’intérêt lié à leurs potentielles fonctions .

Il aura fallu près de dix années supplémentaires pour mettre en évidence leur implication en tant que régulateurs biologiques (notamment au niveau de la régulation de l’expression des gènes) et leurs impacts dans de certains cancers… Aussi, le développement des nouvelles technologies de séquençage à haut débit contribue forcément à cette émergence.

Ce poste est l’occasion de présenter « miRNAtools » qui comme son nom l’indique, regroupe un grand nombre de liens renvoyant vers différents outils dédiés aux miRNA.

– Analyse de données NGS appliquées aux miRNAs (étude des profils d’expression). La liste des 7 softwares présentés n’est pas exhaustive et en voici quelques uns supplémentaires à tester: « mireap », « miRTRAP », « DSAP », « mirena », « miRNAkey », « SeqBuster », « E-mir », … . Une comparaison de l’efficacité de certains de ces outils fera l’objet d’un prochain poste.

– Prédiction de cibles selon les miRNA étudiés.

– Analyse de pathways impliquant les miR d’intérêt. Pour cette dernière application, le soft DIANA LAB – Mirpath proposé, bien que facile d’utilisation et gratuit, a le défaut de ne s’appliquer qu’aux organismes « humain » et « souris ». Dans ce registre et moyennant quelques milliers d ‘euros, « Ingenuity Pathway Analysis » (« IPA ») reste de loin l’outil idéal. En effet, en plus d’identifier les voies métaboliques au sein desquels sont impliqués les miR modulés comme proposé par Mirpath, « IPA » permet également d’intégrer les résultats de modulation de miR et d’expression de gènes pour une même condition d’étude…

« La réalité virtuelle » ou « la réalité augmentée », « l’art génératif » ou encore « l’art interactif », autant de déclinaisons possibles pour designer « l’art virtuel« . Cette forme d’art nouveau est à la croisée des chemins de l’informatique, de la technologie ou encore du graphisme.

« La réalité virtuelle » ou « la réalité augmentée », « l’art génératif » ou encore « l’art interactif », autant de déclinaisons possibles pour designer « l’art virtuel« . Cette forme d’art nouveau est à la croisée des chemins de l’informatique, de la technologie ou encore du graphisme.

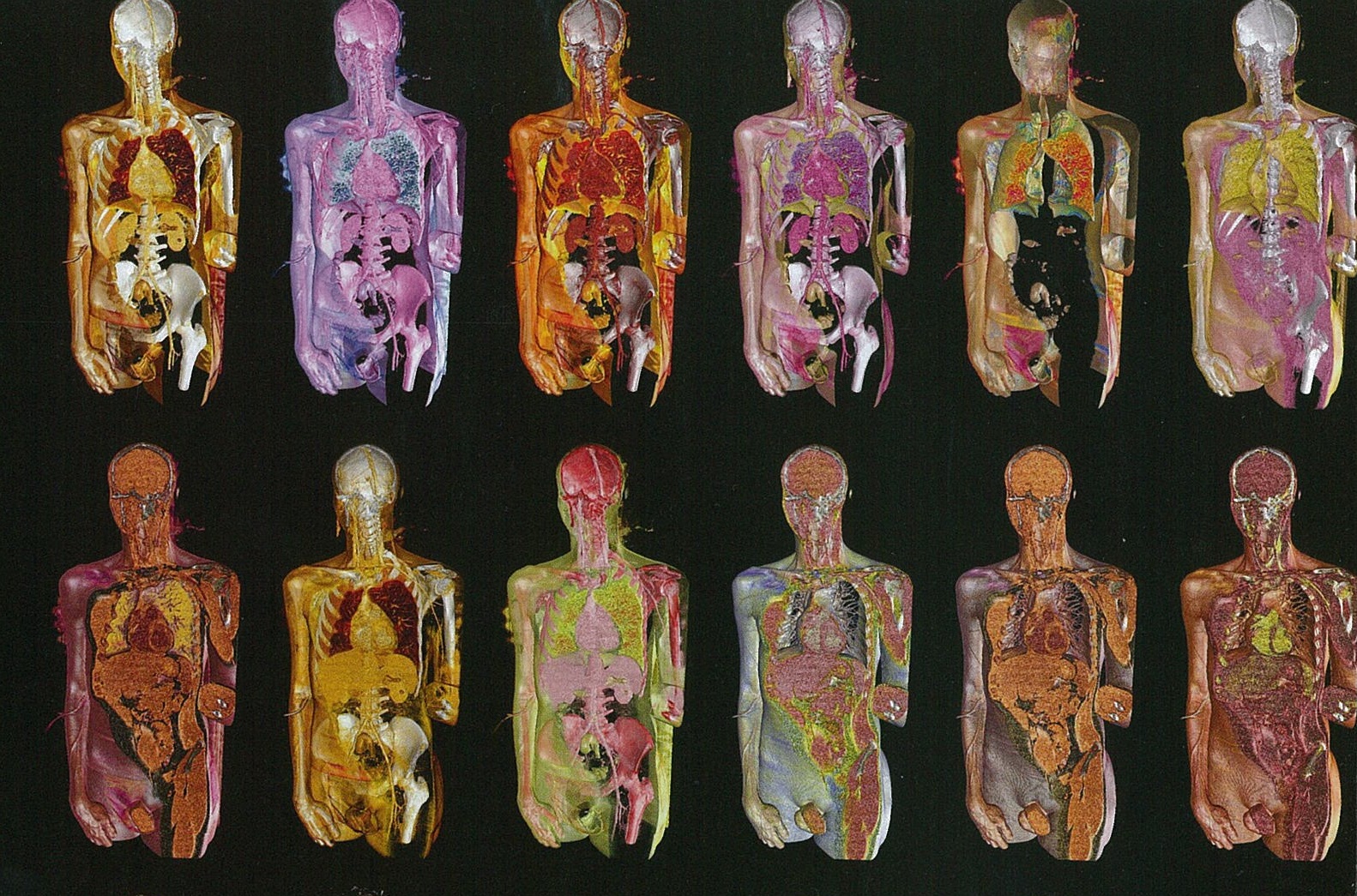

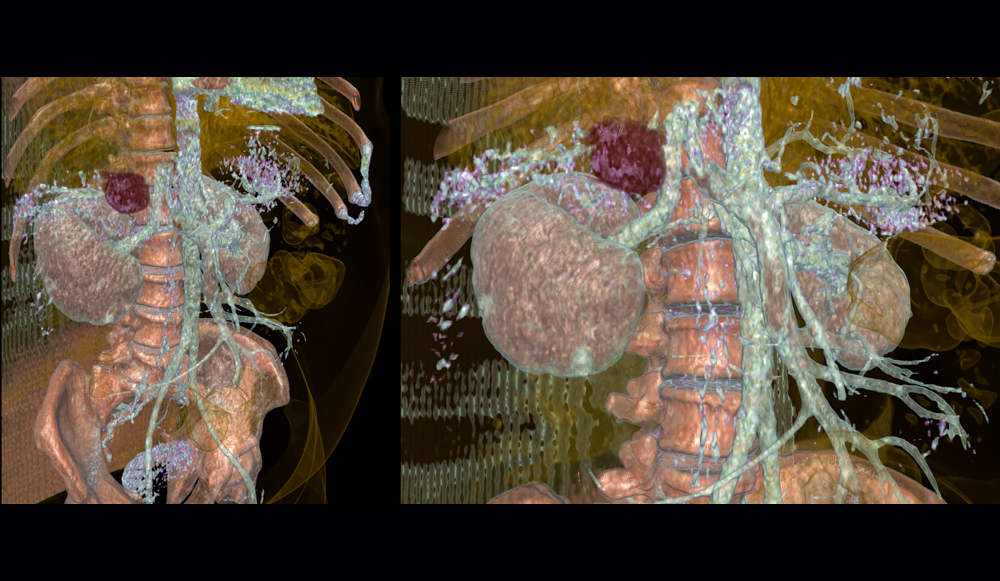

Parmi les plus médiatiques de la discipline, à la fois radiologue et photographe, Rodolphe von Gombergh détourne les techniques de l’imagerie médicale de pointe (ultra-sons, ondes électromagnétiques, rayons X et imagerie 3D) pour créer son propre univers et révéler ses secrets dans l’art de la trans-apparence ( Une des modalités du Bio Art évoqué au cours d’un article précédent).

Dès les prémisses de l’imagerie médicale, il se passionne pour la discipline et, fort d’une équipe de recherche et développement, contribue à l’explosion de l’imagerie médicale moderne. les procédés utilisés permettent de modéliser le corps humain en faisant apparaître les organes comme transparents. Cet explorateur des corps eut l’occasion d’exposer ses premières images médicales au musée Beaubourg. Dix ans plus tard, c’est au musée Guimet que seront livrées les découvertes des scanner des célèbres bouddhas du XI au XVII ème siécle (http://www.dailymotion.com/video/xqtdo2_virtual-art-ou-la-science-qui-se-mele-a-l-art_news).

Sur le plan médical, il est aisé d’imaginer la puissance de ces méthodes non invasives pour le dépistage d’anomalies (exemple ci dessous présentant une tumeur de la surrénale), d’autant qu’elles ne nécessitent aucune anesthésie ni ne présentent de risque d’infection pour le patient…

Qui sommes nous?

Christophe Audebert [@]

En charge de la plateforme génomique

du département recherche et développement

de la société Gènes Diffusion .

En charge de la plateforme génomique

du département recherche et développement

de la société Gènes Diffusion .

Renaud Blervaque [@]

Biologiste moléculaire, chargé d'études génomiques.

Biologiste moléculaire, chargé d'études génomiques.

Gaël Even [@]

Responsable bioinformatique au sein

du département recherche et développement de la société Gènes Diffusion.

Responsable bioinformatique au sein

du département recherche et développement de la société Gènes Diffusion.

Catégories

- Analyse de données (14)

- Automatisation (5)

- Bioinformatique (27)

- Biologie (56)

- biologie transverse (35)

- Biotechnologie (30)

- Chronique littéraire (8)

- Comparatif (6)

- Diagnostic (8)

- Economie (17)

- Epidemiologie (2)

- Evénement (17)

- Formation (3)

- Gestion de projet (5)

- Grille de calcul (1)

- Intégration (5)

- Logiciels (8)

- Médecine (14)

- politique de la recherche (17)

- Recherche (21)

- Séquençage (70)

- Séquenceur (39)

- Uncategorized (25)

- Workflow (4)

Accès rapide aux articles

- Covid-19 : zoom sur les vaccins

- Comment l’ADN pourrait être le stockage de données du futur

- COVID-19 : la data visualisation au service de la science

- COVID-19 : des explications et un point d’étape au 20 février 2020

- Pour mettre du vin dans son eau

- Des petits trous, toujours des petits trous…

- Qui serait candidat ?

- Un robot pour analyser vos données…

- Monde de dingue(s)

- L’art et la manière de développer une qPCR

- Un MOOC Coursera sur le WGS bactérien

- Chercheurs & enseignants-chercheurs, l’art du multitâche.

- Un jeu de données métagénomiques

- Facteur d’impact

- Microbiote & smart city : juxtaposition de tendances

Accès mensuels

- février 2021 (1)

- décembre 2020 (1)

- février 2020 (2)

- septembre 2019 (1)

- avril 2018 (2)

- décembre 2017 (1)

- novembre 2017 (2)

- juillet 2017 (2)

- juin 2017 (5)

- mai 2017 (4)

- avril 2017 (3)

- mars 2017 (1)

- janvier 2017 (2)

- décembre 2016 (3)

- novembre 2016 (4)

- octobre 2016 (2)

- septembre 2016 (2)

- août 2016 (3)

- juillet 2016 (2)

- juin 2016 (4)

- mai 2016 (3)

- mars 2016 (1)

- novembre 2015 (2)

- avril 2015 (1)

- novembre 2014 (1)

- septembre 2014 (1)

- juillet 2014 (1)

- juin 2014 (1)

- mai 2014 (1)

- avril 2014 (1)

- mars 2014 (1)

- février 2014 (3)

- janvier 2014 (1)

- décembre 2013 (5)

- novembre 2013 (2)

- octobre 2013 (2)

- septembre 2013 (1)

- juillet 2013 (2)

- juin 2013 (2)

- mai 2013 (4)

- avril 2013 (2)

- mars 2013 (1)

- février 2013 (3)

- janvier 2013 (2)

- décembre 2012 (2)

- novembre 2012 (2)

- octobre 2012 (2)

- septembre 2012 (2)

- août 2012 (1)

- juillet 2012 (3)

- juin 2012 (5)

- mai 2012 (5)

- avril 2012 (6)

- mars 2012 (6)

- février 2012 (8)

- janvier 2012 (6)

- décembre 2011 (5)

- novembre 2011 (6)

- octobre 2011 (6)

- septembre 2011 (7)

- août 2011 (5)

- juillet 2011 (8)

Pages