Vous pouvez tout aussi bien lire cet article en sur le site du Monde : http://www.lemonde.fr/sciences/. Il s’agit du point de vue proposé par Guillaume Miquelard-Garnier, cofondateur du think-tank l’Alambic et maître de conférences au CNAM.

Vous pouvez tout aussi bien lire cet article en sur le site du Monde : http://www.lemonde.fr/sciences/. Il s’agit du point de vue proposé par Guillaume Miquelard-Garnier, cofondateur du think-tank l’Alambic et maître de conférences au CNAM.

Les grandes questions médiatiques du moment concernant l’enseignement supérieur et la recherche, qu’il s’agisse par exemple du campus Paris-Saclay, des partenariats public-privé à l’université, ou des MOOCs [Massive Open Online Courses, cours en ligne ouverts et massifs], laissent souvent de côté une problématique pourtant essentielle : quelle politique de recrutement à court ou moyen terme envisage-t-on pour la recherche académique française, et subséquemment, qui pour faire la recherche en France ?

Historiquement, le système français était plutôt fondé sur des crédits dits récurrents (attribués directement aux laboratoires et répartis ensuite entre chercheurs). Le fonctionnement typique d’un laboratoire était un assemblage de petites équipes « pyramidales » de permanents (un chercheur senior, deux ou trois chercheurs junior) avec un recrutement plutôt jeune, et donc relativement peu d’étudiants ou de chercheurs « précaires » (attaché temporaire d’enseignement et de recherche, post-doctorants…).

Si l’on préfère, le fonctionnement se faisait avec un ratio permanents/non-permanents élevé. Dans ce système, le chercheur junior est celui qui est en charge de faire la recherche au quotidien, d’obtenir les résultats et d’encadrer de près, avant de, plus expérimenté, migrer vers des activités de mentorat scientifique de l’équipe (rôle du chercheur senior).

Ce fonctionnement était à l’opposé de celui, par exemple, des Etats-Unis. La recherche y est financée exclusivement ou très majoritairement sur projet, c’est-à-dire par « appels d’offres » ou « appels à projets ». Les chercheurs, principalement à titre individuel, décrivent leurs idées sous forme de projets à des agences gouvernementales ou des industriels, une sélection étant ensuite effectuée par des panels d’experts et l’argent réparti en fonction de ces choix.

Dans ce système, il y a peu de permanents, beaucoup de non-permanents recrutés sur les budgets issus des appels à projets pour la durée de ceux-ci, et un fonctionnement « individuel » (chaque chercheur, junior ou senior, gère son propre groupe de doctorants et post-doctorants, en fonction de son budget). Le chercheur est, dès son recrutement (aux USA, la tenure track), un chef de groupe-chef de projets, dont le rôle est de définir les grandes orientations intellectuelles, de trouverles financements, de les répartir et de recruter. La recherche proprement dite est alors très majoritairement effectuée par les non-permanents.

SITUATION ALARMANTE

Il n’est pas, ici, question de débattre des avantages et inconvénients des deux systèmes. Le premier favorise le mandarinat et un système de « rente scientifique » quand le second amène une tendance à l’effet Matthieu (6 % des chercheurs américains monopolisent 28 % des financements) et mise beaucoup pour le recrutement des précaires sur un fort attrait des pays asiatiques qui n’est peut-être pas éternel.

Toutefois, il faut constater que, depuis une quinzaine d’années au moins, et encore plus depuis la mise en place de l’Agence nationale de la recherche (ANR) en 2005 et les réformes engagées par Valérie Pécresse et poursuivies jusqu’à aujourd’hui, le système français est en mutation.

Les recrutements sont devenus plus tardifs, autour de 33 ans en moyenne pour un maître de conférences ou un chargé de recherches, soit typiquement cinq ou six années après l’obtention de la thèse (pour les sciences dures). Les financements récurrents ont été largement diminués au profit des financements par projet. Les appels à projets, principalement par le biais de l’ANR ou européens, ont développé les recrutements de post-doctorants. Les initiatives pourpromouvoir l’excellence individuelle des chercheurs se sont multipliées (la prime d’excellence scientifique pérennisée même si rebaptisée, les bourses jeunes chercheurs nationales ou européennes sur un modèle de tenure track ou servant à financer un groupe de recherche indépendant).

Or, plus récemment, la révision générale des politiques publiques (RGPP) conduit, malgré l’autonomie des universités, à un effondrement alarmant des recrutements de chercheurs et enseignants-chercheurs permanents à l’université et dans les établissements publics à caractère scientifique et technologique (EPST). En trois ans, le CNRS est passé de 400 chercheurs recrutés par an à 300 (soit d’environ 350 à 280 jeunes chercheurs). Cette année, on compte au total 1 430 postes de maîtres de conférences ouverts au concours alors qu’il y en avait encore 1 700 il y a deux ans et 2 000 il y a cinq ans. Cette situation a conduit le conseil scientifique du CNRS à s’alarmer récemment, et ne devrait pas s’améliorer à la suite des énormes problèmes financiers de bon nombre d’universités, dont le symbole est Versailles-Saint-Quentin.

En parallèle, le budget de l’ANR alloué aux projets est passé de plus de 600 millions d’euros en 2010 à moins de 500 actuellement, le nombre de projets financés de 1 300 en 2010 à très certainement moins de 1 000 en 2014.

A cela s’ajoutent les effets liés à la loi Sauvadet de 2012. Cette loi favorisant la titularisation des personnels contractuels après six ans passés dans la fonction publique a jeté un froid dans certains laboratoires et certaines disciplines scientifiques (notamment celles qui recrutaient plutôt à 35 ans qu’à 31…). Les budgets ne permettant que rarement ces « cdisations » non planifiées, les ressources humaines des organismes sont aujourd’hui très craintives et rendent difficile l’embauche d’un post-doctorant dès la quatrième voire la troisième année.

La baisse du budget de l’ANR, censée s’accompagner d’une revalorisation des financements récurrents, a d’ailleurs probablement et principalement servi àfinancer ces titularisations non anticipées dans la mesure où l’argent n’est en tout cas pas arrivé jusqu’aux laboratoires. En lien avec cette loi Sauvadet et cette résorption de la « précarité » dans l’enseignement supérieur et la recherche, on peut également souligner que les règles de l’ANR concernant l’embauche de contractuels ont été rendues plus drastiques : il faut aujourd’hui trois permanents à temps plein sur un projet pour recruter un non-permanent à temps plein pour la durée de celui-ci.

AU MILIEU DU GUÉ

Nous nous trouvons donc aujourd’hui au milieu du gué, et l’on se demande si nous y sommes arrivés de façon réfléchie ou simplement par suite de tiraillements successifs et aléatoires vers les directions opposées prises par ces deux systèmes.

Des financements récurrents qui ont quasiment disparu mais également des financements sur projets qui s’effondrent. Des permanents qui ont de moins en moins de temps à consacrer à la pratique de la recherche pour en passer de plus en plus à la gestion (de projets, de groupes) pour les plus talentueux ou chanceux, et à la lutte pour l’obtention des crédits nécessaires à leur activité pour les autres. Et de moins en moins de docteurs non permanents dans les laboratoires et de plus en plus de difficultés à les financer ou plus simplement à les attirer (puisqu’on ne peut honnêtement plus rien leur promettre et que les salaires proposés ne sont toujours pas compétitifs).

La question se pose alors simplement : qui, en dehors des quelques doctorants passionnés qui pourront encore être financés (et alors que les difficultés d’insertion des docteurs sont toujours récurrentes en France, ce qui est tout sauf une incitation à envisager le doctorat comme un choix de carrière judicieux), fera demain de la recherche dans les laboratoires publics en France ?

Point de vue : LE MONDE SCIENCE ET TECHNO | 05.05.2014 à 17h00 • Mis à jour le 07.05.2014 à 13h57

A l’occasion de son stage d’observation, la jeune Marieke nous fait partager ses remarques suite à son passage sur la plateforme de génomique Pegase-biosciences. Ce point de vue peut permettre à d’autres jeunes lycéens ayant une inclination pour le monde de la recherche en sciences de la vie de confirmer ou d’infirmer leur motivation pour débuter un parcours scientifique. Comme quoi, parfois, ces stages d’observation peuvent être un peu plus qu’une figure imposée.

Laissons la parole à Marieke !

Dans le cadre de mon année de 1ère S, j’ai effectué un stage d’observation d’une semaine, à l’Institut Pasteur de Lille. Ayant un attrait pour les sciences, je voulais découvrir le milieu de la recherche. J’avais quelques a priori que je voulais confirmer ou non, savoir si ce domaine me convient. Pendant ce stage, j’ai échangé avec 18 scientifiques (10 femmes, 8 hommes) travaillant à l’Institut Pasteur de Lille en recherche biologique. Je me suis intéressée au groupe BDPEE (axé parasitologie), et au groupe Pégase (axé génomique). En amont du stage, je me posais plusieurs questions : quels sont les métiers relatifs à la recherche, pour quel profil particulier, quelles formations pour y accéder ?

Commençons par la conclusion ! De tous ces entretiens, il en est ressorti un constat global : quelle que soit la profession exercée, le secteur de la recherche regroupe des personnes passionnées et curieuses, pour qui la science semble être une vocation. Le domaine de la recherche demande également de la rigueur, de l’organisation et un esprit de synthèse. Ces qualités sont fondamentales pour la quasi-totalité des chercheurs.

Age moyen : 30 ans

Répartition : 10 femmes (55%), 8 hommes (45%)

Nombre moyen d’années post bac : environ 5

Emploi actuel est le premier : 80%

En réalisant les interviews, j’ai constaté qu’il existait des professions différentes au sein de la recherche. Pour faciliter leur description, je les ai rassemblées par domaine.

A- Biologie « in vitro [1] »

(i) Enseignement – chercheur : 50 % recherche, 50 % enseignement

(maître de conférences, professeur)

Les 2 fonctions sont très complémentaires et se renforcent mutuellement. Les maîtres de conférences actualisent leur cours grâce aux publications et leurs travaux de recherche permettent de garder un pied dans la communauté scientifique. La transmission, le partage du savoir apportent une vraie satisfaction, complétée par le projet de recherche. Avec la HDR (Habilitation à Diriger les Recherches), les maîtres de conférences et professeurs encadrent les doctorants. Enfin, malgré peu de postes disponibles, le statut de fonctionnaire est synonyme de sécurité d’emploi.

La volonté de vouloir poursuivre des recherches, la préparation des cours, la constitution de la bibliographie (c’est-à-dire la mise à jour en continu des connaissances liées à la thématique d’étude), la recherche de moyens pour financer le projet de recherche, nécessite beaucoup de temps. Cependant cet investissement parait secondaire si l’avidité de connaissances et la curiosité sont au rendez-vous.

(ii) Gestion du laboratoire et des projets de recherche : 50 % recherche, 50 % gestionnaire

(chargé de recherche, chargé d’études)

La gestion du laboratoire implique la mise en place et l’encadrement de projets de recherche. Le chargé de recherche développe et teste des idées par la conceptualisation de protocoles, ce qui demande une capacité de concentration importante. Il encadre l’équipe technique en gérant les relations avec le reste de l’entreprise ou de l’équipe de recherche.

(iii) Equipe Technique et Ingénieur : 50 % recherche, 50 % production

(technicien, ingénieur d’étude, ingénieur de recherche)

Ces personnes collaborent aux découvertes : autant sur la mise en place des protocoles que sur les manipulations. Elles prennent part aux discussions pour enrichir et interpréter les hypothèses de travail. Le renouvellement des technologies et des techniques enrichit les connaissances, et ne laisse pas de place à la monotonie. L’autonomie et les responsabilités sont également un aspect plaisant de cette fonction. Cette profession permet une évolution de carrière.

B- Biologie « in silico [2] », Bio-informatique

(bio-informaticien, ingénieur de recherche, analyste en génétique quantitative)

Les travaux en génomique [3] génèrent un nombre très important de données qu’il faut traiter et analyser afin que les biologistes « in vitro » puissent dégager du sens, l’équipe informatique interprète les données générées, ou crée des algorithmes permettant leur interprétation. Par l’informatique, elle répond à des questions d’ordre biologique, ce qui confère un aspect pluridisciplinaire à ce domaine. L’analyste met en évidence l’essence des résultats à l’aide d’études statistiques. Le renouvellement des problématiques très diverses confère un aspect non répétitif très apprécié.

Cette science s’adresse à des personnes rigoureuses, entreprenantes, ayant un attrait pour les mathématiques (logique, analyse, statistiques).

C’est un métier de plus en plus porteur, car, grâce aux nouvelles technologies (génotypage ou séquençage à haut-débit), les données générées sont de plus en plus importantes et conséquentes.

Lorsque je me suis intéressée à la formation, je me suis rendu compte qu’elles étaient très variées. En effet, il n’y a pas une formation type, classique pour accéder au monde de la recherche. La plupart des interviewés ont un parcours atypique et on constate que les passerelles sont multiples.

Cependant, parmi les différentes orientations, certaines voies sont plus souvent empruntées :

BTS – formation concrète délivrant des bases solides notamment pour les manipulations.

Fac (Licence et Master) – enseignement général, pluridisciplinaire. Recommandé pour les étudiants qui hésitent sur leur orientation. Cependant, cette formation nécessite une motivation non négligeable.

Doctorat – 3 ans consacrés à la réalisation d’une thèse. Il peut éventuellement être « surdiplômant ».

Je trouve que c’est un milieu propice à la réflexion scientifique, passionnant, idéal si on aime s’investir dans des projets. Certains enseignants – chercheurs sont capables de passer 8 ans sur un seul parasite, le Cryptosporidium par exemple.

J’ai été particulièrement impressionnée par la quantité d’anglais. La maîtrise de l’anglais scientifique est une aptitude vitale en recherche pour communiquer lors des congrès, pour lire et rédiger des protocoles et des articles.

Je ne savais pas du tout que la publication avait une place si importante dans le quotidien des chercheurs. A la fois pour se tenir informé des avancées, pour communiquer ses découvertes, pour faciliter l’obtention de moyens financiers, pour critiquer les travaux de recherches, pour se faire reconnaître, les scientifiques publient des articles, souvent en anglais, dans la presse scientifique. La publication est nécessaire pour trouver des financements. Ainsi, une sorte de cercle vicieux s’installe progressivement : il faut des financements pour publier et pour obtenir ces financements, il faut publier. Or plus le journal à une audience importante, plus il a un facteur d’impact élevé et plus il est difficile de publier dans ce journal. Cette pratique, fondamentalement utile au sein de la communauté scientifique, est cependant contestée. Par exemple, au-delà des 192 heures de cours obligatoires, il est demandé aux maîtres de conférences de produire un article par an. Cela peut éventuellement déboucher sur une pratique de la publication déraisonnée et excessive.

[1] In vitro : locution latine signifiant au laboratoire, par extension ici cela désigne les expériences menées au laboratoire

[2] In silico : locution latine signifiant par ordinateur

[3] La génomique est une discipline de la biologie moderne. Elle étudie le fonctionnement d’un organisme, d’un organe, d’un cancer, etc. à l’échelle du génome, et non plus limitée à celle d’un seul gène

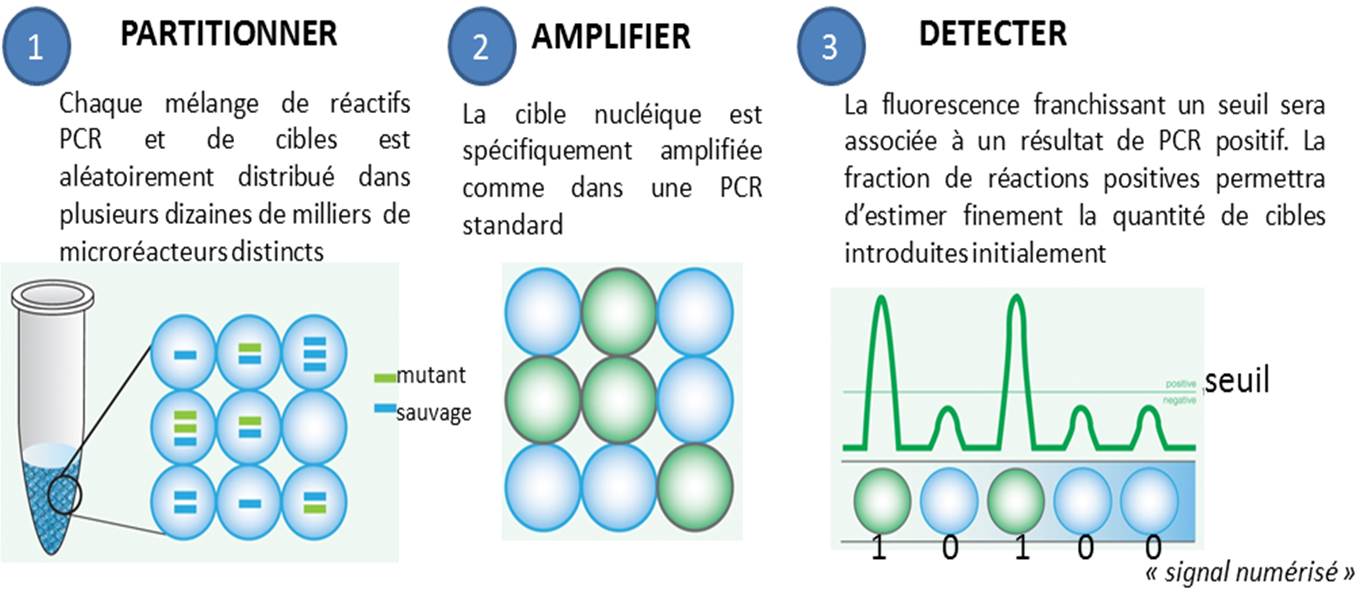

La PCR en point final, celle qui se termine souvent par un dépôt sur gel d’agarose, ainsi que la PCR quantitative, dans laquelle on suit l’évolution de la libération de molécules fluorescentes dont le décollage plus ou moins précoce dépend de la quantité de matrice initialement introduite, se voient déclinées en versions numériques. Par numérique est entendu ici, qu’une PCR peut prendre deux valeurs : 0 ou 1 (idéalement, 0 quand aucune cible n’est introduite au départ d’une PCR et que par voie de conséquence aucun signal issu d’amplification n’est observé, et 1 pour l’exact inverse).

Le principe de la PCR numérique est simple au niveau du concept mais techniquement beaucoup plus difficile à mettre en application. Il s’agit de multiplier le nombre de bio-réacteurs disponibles, ainsi, un échantillon sera partitionné en des milliers de compartiments distincts. Ensuite chaque compartiment sera considéré comme autant de réacteurs indépendants… donc en fin de PCR autant de réactions montrant oui ou non une amplification (autant de 0 et de 1), renvoyant à un système binaire. L’application de la Loi de Poisson permettra ensuite d’estimer très finement la quantité initiale de cibles présentes dans l’échantillon de départ.

Les avantages de la PCR numérique par rapport à la qPCR classique sont assez évidents :

– elle permet une quantification absolue sans établir une courbe standard préalable

– elle est plus sensible voire beaucoup plus sensible. Raindance annonce ainsi détecter un mutant parmi 250 000 molécules sauvages avec une limite inférieure de détection de 1 parmi 1.000.000

– elle est moins sensible aux inhibiteurs. Le fait de diluer la matrice ADN complexe de départ pour la répartir dans un nombre important de réacteurs permet de favoriser le départ de PCR

– elle est nettement plus précise. La technologie sera d’autant plus précise que le nombre de compartiments, le nombre de micro-réacteurs sera important

L’article « Digital PCR hits its stride » (La PCR numérique franchit un nouveau cap) de Monya Baker dans le Nature Methods (juin 2012) permet un aperçu de la technologie qui est passée du concept à des solutions commerciales qui se veulent de plus en plus accessibles.

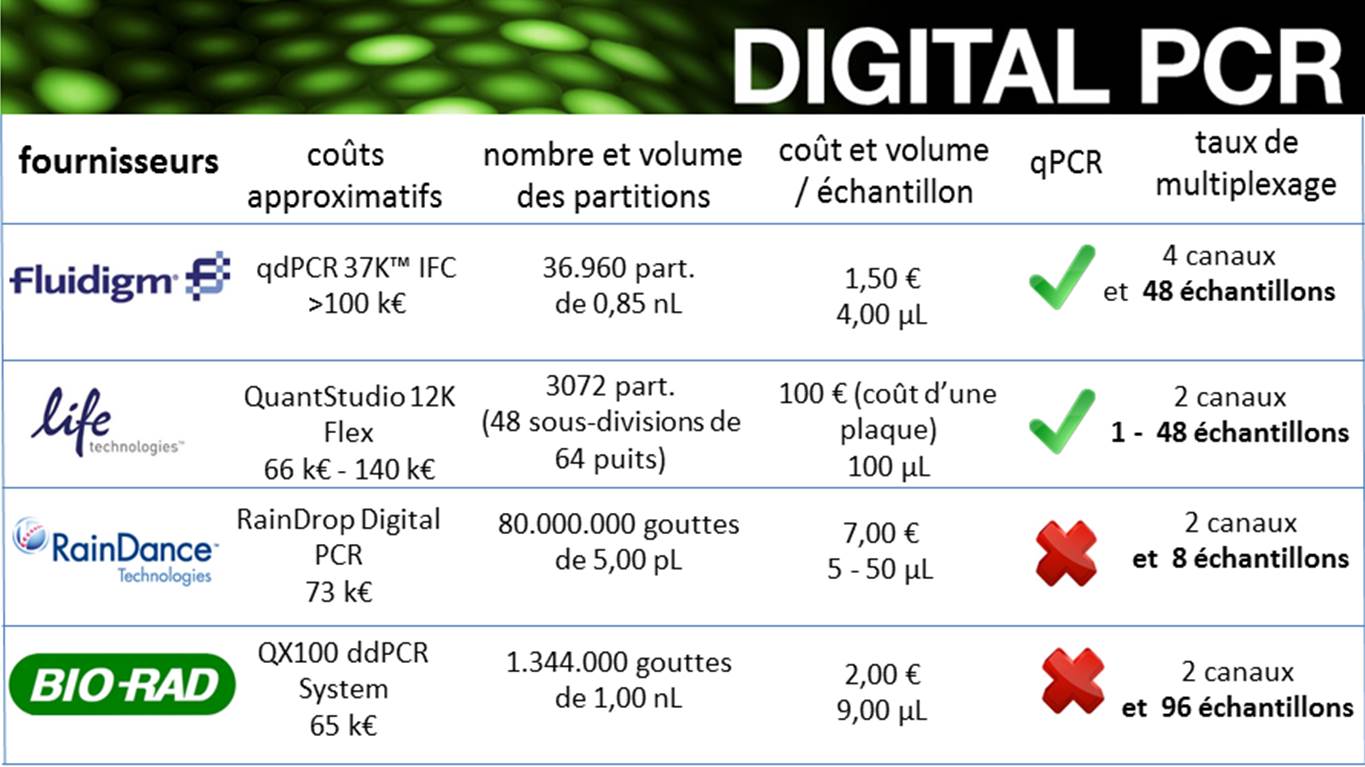

Actuellement, plusieurs fournisseurs proposent des plateformes aux spécifications très différentes. Les quatre fournisseurs ci-dessous proposent des systèmes de PCR numérique basés sur de la microfluidique pour Fluidigm, des interfaces solides (type OpenArray) de Life Technologies et des micro-gouttes pour Raindance et Biorad.

Ainsi, que le mentionne Jim Huggett (chef d’équipe au LGC), cité dans la publication de Monya Baker (Digital PCR hits its stride), la PCR numérique est réservée à des utilisateurs experts et se trouve encore allouée à des applications spécialisées car encore beaucoup plus chère que la PCR quantitative (traditionnelle) qui reste adaptée à la majorité des applications.

Plutôt bien réalisée, voici la campagne d’Illumina pour le lancement de son nouveau séquenceur le NextSeq500, un nouveau séquenceur de paillasse. Ce dernier né des séquenceurs SBS est capable de délivrer de 16 à 120 Gb, selon les modes de séquençage, avec des spécifications permettant d’envisager le séquençage par run de 16 exomes ou 20 transcriptomes ou encore 1 génome humain (à plus de 30 X de profondeur). Quoi qu’il en soit, ce nouveau venu et la campagne marketing qui en résulte, visent à populariser, démocratiser encore et toujours le séquençage pour mieux inonder le marché, c’est parti avec cette publicité…

En ce début d’année, cet article est l’occasion d’aborder rapidement les divers axes de développements, les différents acteurs du séquençage haut-débit de deuxième génération.

– Commençons par Life Technologies et sa gamme Ion Torrent. En fin d’année 2013, la Ion Community (forum où se retrouvent les utilisateurs de la technologie Ion Torrent) s’agite à l’annonce de 3 nouveautés majeures (early access program) :

(i) L’accès à une nouvelle chimie de séquençage, la Hi-Q ™, permettant d’accroître la fiabilité de séquençage. Les erreurs seraient réduites de 90 %, ceci même au niveau des homopolymères, et pour des reads de 400 bases, témoignage de Dag Harmsen à l’appui ! En clair, il semble que ce soit l’enzyme (what else ?) qui ait été remplacé.

(ii) La deuxième annonce concerne l’arrivée de la chimie Avalanche où plusieurs heures d’amplification clonale à l’aide d’un automate One-Touch peuvent être remplacées par l’emploi d’un tube, ce qui prend alors 2 heures pour obtenir une librairie de 500 pb, et ce, de façon isothermique. Un choc de simplification qui ravira les utilisateurs pour lesquels cette étape est limitante.

(iii) La troisième annonce concerne la mise à disposition de kits permettant de réaliser des analyses métagénomiques ciblées 16 S. Un système exploitant le PGM et sa capacité de produire des reads de 400 pb. L’inconnu ici réside dans la mise à disposition de la communauté d’un pipeline analytique performant.

– Qiagen, qui n’est pas connu pour être un acteur de poids sur la scène du séquençage haut-débit, arrive en force en cette année 2014 avec une solution intégrant tous les jalons nécessaires à la complétude d’une étude. Fort de son rachat d’une solution de séquençage (lire l’article : Qiagen investit… le séquençage haut-débit de 2ème génération), Qiagen propose un environnement logiciel des plus intéressants ! En effet, la société néerlandaise a racheté les sociétés CLC Bio et Ingenuity systems. Ces deux sociétés proposent l’une des toutes meilleures solutions d’analyse de séquences: une solution d’assemblage de novo réellement performante grâce à CLC genomics workbench, et Ingenuity systems proposant les pipelines d’analyses suivants: IPA, pour donner un sens biologique aux données omiques, Ireport pour l’analyse de données d’expression et Variant Analysis, un pipeline permettant d’optimiser la recherche de mutations causales.

Ainsi QIAGEN, à l’instar de ce que nous avons tâché de représenter par le schéma ci-dessous, possède actuellement tous les maillons (ou pas loin) d’une chaîne allant de l’échantillon à l’analyse finale traduisant des données de séquences en sens biologique.

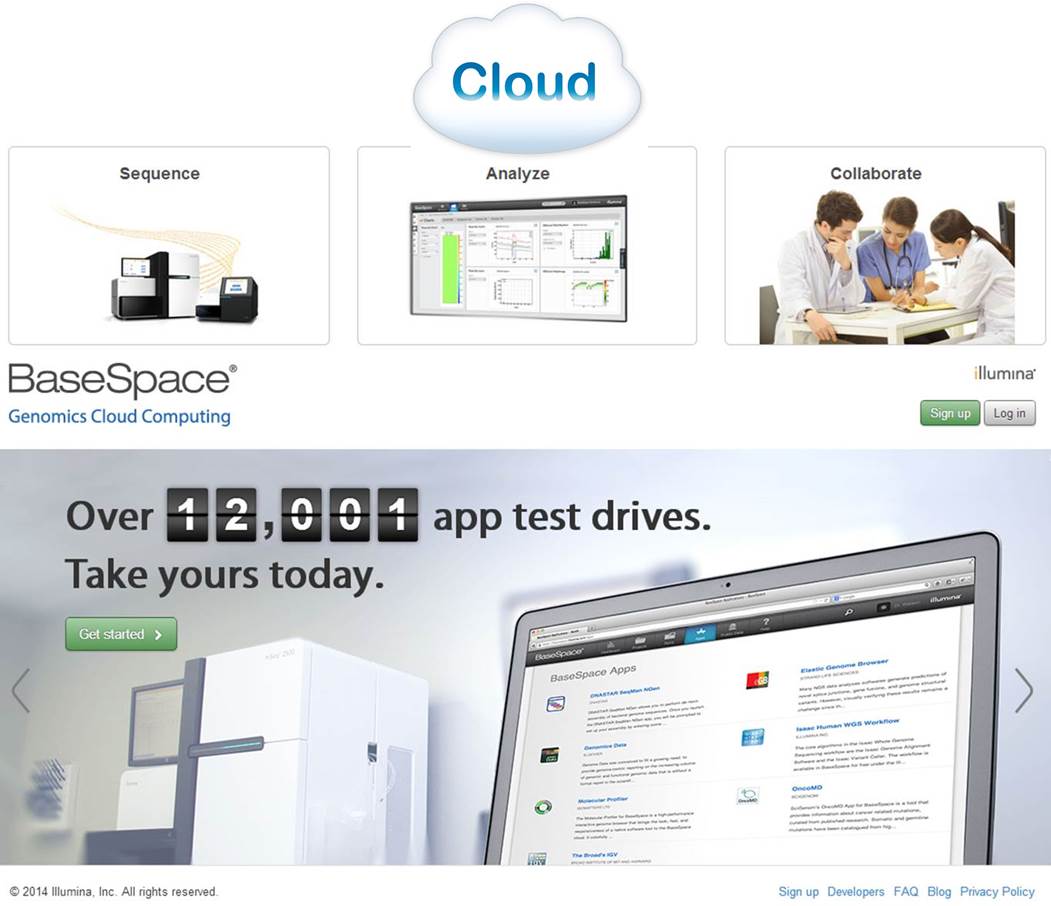

– Illumina, quant à elle, semble avoir l’ambition de devenir une sorte de Apple de la « génomicosphère ». En effet, Illumina propose BaseSpace, un Itunes pour les biologistes. D’ailleurs, notons qu’Illumina propose sur Itunes une application : MyGenome, qui propose « d’explorer un véritable génome humain » et d’afficher des rapports sur les variations génétiques importantes. « L’application MyGenome fournit une interface simple, intuitive, et éducative pour vous lancer à la découverte du génome humain« . Revenons à BaseSpace, une interface entre vous et un cloud hébergeant des applications et des données permettant d’analyser les séquences en sortie de MiSeq ou HiSeq. Ce cloud permet aux utilisateurs de délocaliser le stockage de leurs données. L’idée : simplifier au maximum l’analyse par la mise à disposition d’outils et la mise en réseau des utilisateurs. Illumina s’est aperçu que si le goulot d’étranglement constitué par l’analyse de données de séquençage haut-débit volait en éclat, nécessairement les runs pourraient se multiplier avec leur chiffre d’affaire. Le schéma ci-dessous reprend quelques éléments de la solution analytique développée par Illumina.

Une communauté de plus de 12000 utilisateurs, un espace permettant l’utilisation d’une vingtaine d’applications. L’objectif d’Illumina : créer un espace attractif, émulant et incitant les intervenants à mettre à disposition les applications développées en priorité sur cet espace. Anticipant une demande exponentielle d’analyses et d’espace de stockage lorsque le HiSeq a été intégré au BaseSpace, Illumina a décidé de mettre en place une politique de tarification qui limiterait la quantité d’espace libre pour stocker et traiter les données génomiques dans le cloud. En vertu de cette logique, les utilisateurs reçoivent un téraoctet gratuit d’espace pour le stockage et le traitement des données et seraient alors en mesure d’acheter du stockage supplémentaire par incréments de téraoctet ou 10 téraoctets – un téraoctet coûterait 250 $ par mois ou $ 2,000 d’avance pour une année complète , tandis que 10 téraoctets seraient à 1500 $ par mois ou une avance des frais annuels de $ 12 000 (données chiffrées début 2013).

En conclusion, si les années précédentes ont vu le lancement de nouveaux séquenceurs, avec depuis 2011 l’arrivée de séquenceurs de paillasse, les années 2013-2014 attendent la diffusion de séquenceurs de 3ème génération. Qiagen est un petit nouveau dans la course, ce nouvel acteur est capable, sans réel développement, de proposer une solution complète grâce à une stratégie de rachat pertinente. Illumina et Life Technologies, pendant ce temps, poursuivent leur développement en essayant d’émuler les utilisateurs avec, respectivement, leur BaseSpace et Ion Community. L’opérateur historique, Roche est le grand silencieux avec une stratégie peu lisible…

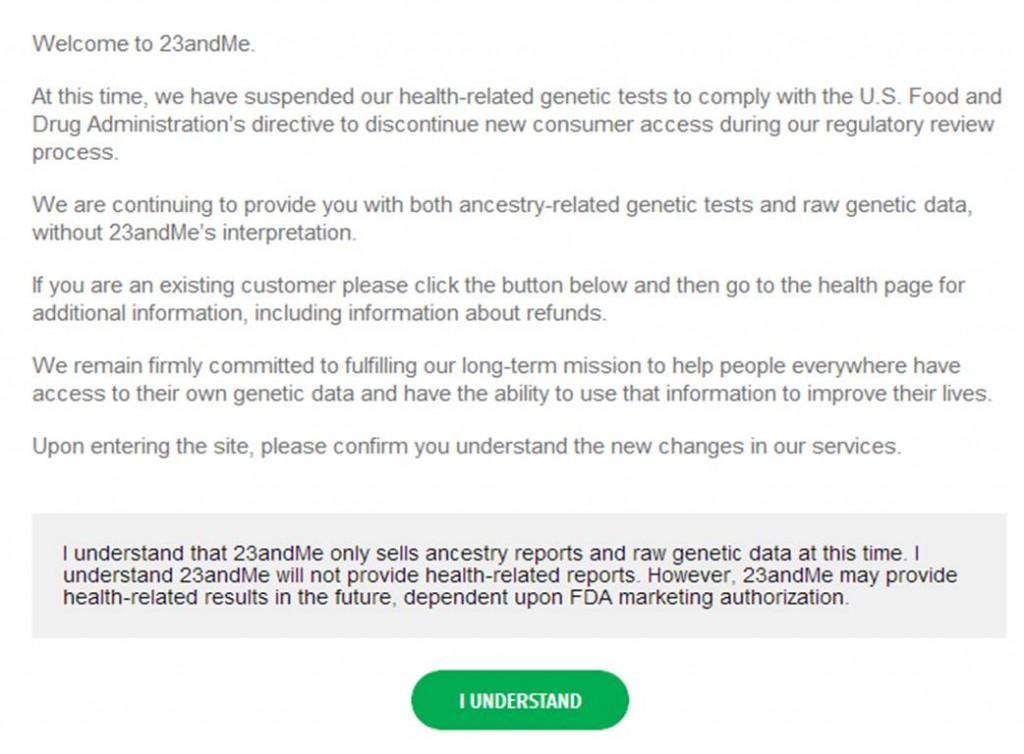

La toute puissante FDA (Food and Drug Administration) a calmé les ardeurs la société 23andMe en remettant en question la diffusion par la société californienne de tests génomiques personnels. (Étonnamment ?), la FDA ne semble pas réellement heurtée par le principe même d’une société de droit privé glanant des informations génomiques pour réaliser un commerce des plus lucratifs, motus concernant le devenir de ce type de données. En réalité, l’administration américaine, soucieuse du service rendu au consommateur, émet des doutes quant à la pertinence, quant à l’exploitation des résultats, après génotypages, des individus consentants, ainsi que sur la façon dont le tout est présenté au consommateur. Ainsi, 23andMe est mise en cause au niveau de la qualité de son service. Voici son seul « crime » aux yeux de la FDA!

La toute puissante FDA (Food and Drug Administration) a calmé les ardeurs la société 23andMe en remettant en question la diffusion par la société californienne de tests génomiques personnels. (Étonnamment ?), la FDA ne semble pas réellement heurtée par le principe même d’une société de droit privé glanant des informations génomiques pour réaliser un commerce des plus lucratifs, motus concernant le devenir de ce type de données. En réalité, l’administration américaine, soucieuse du service rendu au consommateur, émet des doutes quant à la pertinence, quant à l’exploitation des résultats, après génotypages, des individus consentants, ainsi que sur la façon dont le tout est présenté au consommateur. Ainsi, 23andMe est mise en cause au niveau de la qualité de son service. Voici son seul « crime » aux yeux de la FDA!

L’administration américaine lui reproche :

– malgré les sollicitations récurrentes de la part de la FDA, 23andMe n’a pas fait valider par l’administration ses dispositifs diagnostiques in vitro. Elle n’a cessé d’allonger la liste (stratégie commerciale du restaurant chinois) des maladies et caractères que leur système était susceptible de diagnostiquer -avant « sa mise en demeure », 23andMe proposait un menu comportant le « diagnostic » de 254 prédispositions à des « maladies » ou aptitudes diverses.

– au sujet des maladies multi-factorielles, telles que le cancer de l’ovaire ou du sein, les résultats rendus aux clients sont très probablement constitués d’un grand nombre de faux positifs et de faux négatifs.

la FDA souhaite que l’intégralité des assertions de 23andMe soit validée pour que la société continue de vendre son kit phare : health-related genetic tests.

La société qui comptait régner en maître sur le marché de la génomique récréative, a peut-être fini de jouer les apprentis sorciers (franchement peu probable !). En effet, si l’intérêt de certains de ces tests génomiques, en soi, n’est pas à remettre en question, leur encadrement législatif est à souhaiter. En outre, avant de valider des kits « diagnostiques », il serait appréciable de lever le quiproquo : les kits proposés par 23andMe sont ils des dispositifs de génomique récréative ou des dispositifs médicaux ? La libéralisation incontrôlée de ce type de marchés pourrait avoir des conséquences dramatiques… Si des prédispositions peuvent être inscrites dans notre code génétique, il n’en demeure pas moins qu’une large majorité de maladies peut être qualifiée de multifactorielle.

Se sentir à l’abri d’une maladie parce que 23andMe vous rend un résultat dans ce sens ou dans le cas contraire, sentir l’ombre de l’épée de Damoclès, peut avoir, pour le consommateur de ces tests, des conséquences graves.

La lettre d’avertissement du 22 novembre 2013, de la FDA adressée à Anne Wojciki, montre l’étendue de l’ambiguïté : LETTRE d’AVERTISSEMENT ainsi que la réponse de 23andMe.

Anne Wojcicki a déclaré que « 23andMe travaille activement avec la FDA pour s’assurer que la firme fournit des informations de haute qualité afin que les consommateurs puissent avoir confiance ».

Ci-dessous, voici la nouvelle page qui vous accueille sur le site de 23andMe qui peut continuer à vendre ses tests phylogénétiques.

Comme le disait Stephen Hawking :

« J’ai remarqué que même les gens qui affirment que tout est prédestiné et que nous ne pouvons rien y changer regardent avant de traverser la rue. » (Trous noirs et bébés univers, Éditions Odile Jacob, 1994)

Le séquençage haut-débit voit cohabiter depuis quelques années deux générations de séquenceurs.

Au passage, une question Trivial Pursuit pour laquelle il faudra avoir un œil de caracal : quelqu’un sait quelle société a développé la première génération de séquenceurs haut-débit ? et quand ?

Les séquenceurs de deuxième génération se voient conditionnés sous forme de séquenceurs de paillasse (PGM de Ion Torrent, Miseq d’Illumina, GS-junior de Roche) permettant une démocratisation du séquençage, pendant que leurs grands frères pulvérisent la loi de Moore pour envisager un rendement (coût / Mb) toujours plus compétitif.

La large diffusion du séquençage de 3ème génération se laisse désirer laissant le champ libre à la génération précédente. Cet article vise à réaliser un court état des lieux du séquençage haut-débit de troisième génération : un futur plus ou moins lointain, de nouvelles applications potentielles.

La question : séquenceurs de 3ème génération, l’âge de raison, c’est pour quand ? est l’interrogation qui a hanté l’AGBT 2013 marqué par le silence d’Oxford Nanopore. Cette année 2013 fut marquée par le retrait d’Illumina du capital de la société britannique : « Oxford Nanopore Technologies Ltd a annoncé la vente d’une participation détenue par son concurrent américain Illumina Inc., une étape vers la fin d’une relation pleine de conflits dans la course au développement des séquenceurs haut-débit permettant de séquencer plus rapidement et pour moins cher. »

Avant de caractériser ce que sont, seront, pourront être les 3ème générations de séquenceurs, commençons par un rapide tour des caractéristiques générales de leurs prédécesseurs et principalement de ce qui constitue leurs points faibles :

– la phase d’amplification clonale (réalisée par PCR) est source de biais (doublons, erreurs de PCR)

– les problèmes liés au déphasage engendrant une chute de la qualité le long du read produit (ce qui bride la production de reads vraiment longs)

-des reads courts (de moins d’une centaine à environ 800 bases – vous l’aurez noté ce point est en partie une conséquence du précédent)

-des machines et des consommables onéreux

– des temps de run longs

Ainsi l’objectif principal des séquenceurs de 3ème génération est de palier les défauts de leurs aînés en produisant des reads plus longs, plus vite pour moins cher. Les séquenceurs de 2ème génération, quels que soient leurs modes de détection (mesure de fluorescence, mesure de pH) sont trop peu sensibles pour envisager la détection d’une simple molécule, d’un simple nucléotide : nécessairement la librairie doit être amplifiée, ce qui provoque des biais, des temps de préparation relativement longs et l’usage de consommables qui impacte le coût final de séquençage… assez rapidement la qualité chute plus vos reads s’allongent ce qui oblige à brider les tailles de reads que ces technologies sont capables de délivrer. En outre, travaillant sur une matrice qui est une copie de votre librairie initiale, l’information portée par les bases méthylées est perdue (ceci oblige à ajouter une phase de traitement au bisulfite qui peut être hasardeuse)

Actuellement l’une des seules technologies de 3ème génération réellement utilisée est celle de Pacific Biosciences (les hipsters disent « PacBio »). La firme, fondée en 2004, a lancé en 2010, son premier séquenceur de troisième génération le Pacbio RS basé sur une technique de séquençage SMRT (Single Molecule Real Time sequencing.) Aujourd’hui la société Roche qui n’a pu absorber Illumina lors de son OPA, a investi 75 millions de USD, le 25 septembre 2013, pour co-développer des kits diagnostiques in vitro exploitant la technologie de PacBio.

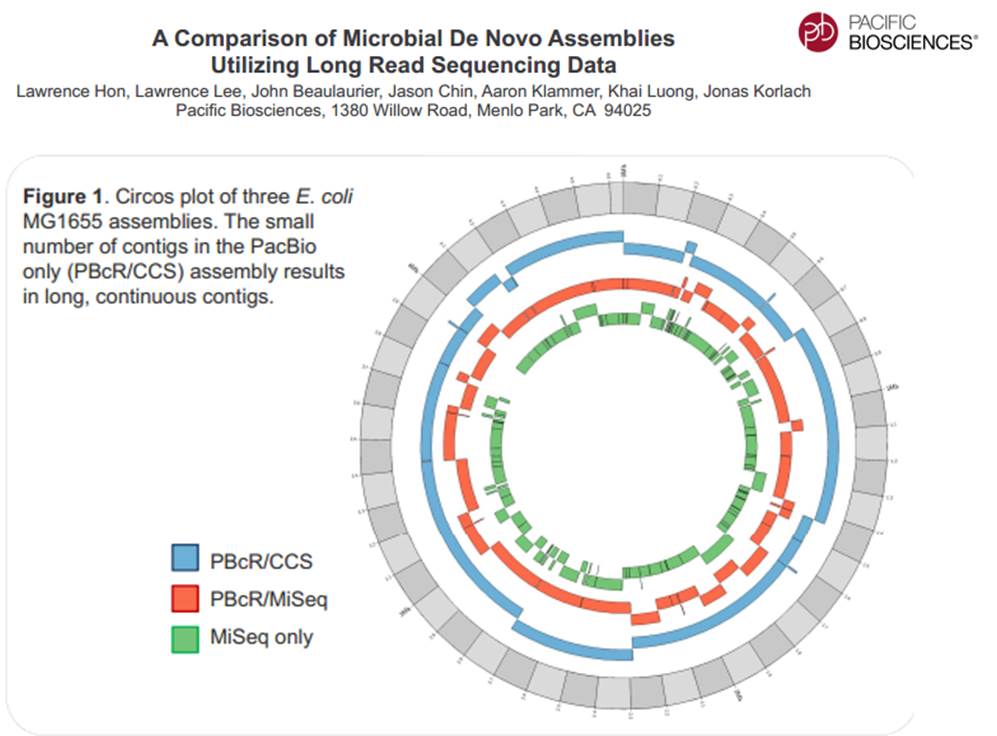

La technologie de PacBio est aujourd’hui exploitée pour réaliser du séquençage de novo de petits génomes :

Avec ces 200 à 300 Mb délivrés par SMRT-cell, séquencer des organismes eucaryotes supérieurs demande un investissement important, malgré tout, cette technologie délivrant des reads de plusieurs milliers de bases, permet d’envisager une diminution du nombre de contigs obtenus par les seules stratégies reads-courts / gros débit.

Face à la technologie proposée par PacBio, d’autres technologies essaient d’émerger pour arriver à occuper le marché du séquençage de 3ème génération :

– La combinaison détection optique et multipore est une voie envisagée pour le séquençage de 3ème génération avec le travail mené par NobleGen biosciences.

– L’imagerie directe de l’ADN

Le microscope électronique offre une résolution possible jusqu’à 100 pm, de sorte que les biomolécules et les structures microscopiques tels que des virus, des ribosomes, des protéines, des lipides, des petites molécules et des atomes même simples peuvent être observés. Bien que l’ADN est visible lorsqu’on l’observe avec un microscope électronique, la résolution de l’image obtenue n’est pas suffisamment élevée pour permettre le déchiffrement de la séquence, c’est à dire, le séquençage de l’ADN. Cependant, lors du marquage différentiel des bases de l’ADN avec des atomes lourds ou des métaux, un tel séquençage devient possible.

– Le séquençage à l’aide de transistor (Transistor-mediated DNA sequencing– une technologie développée par IBM)

Dans le système conceptualisé par IBM, l’ADN est contraint de passer par le pore à cause de la tension électrique subie, la vitesse de passage de la molécule à séquencer est maîtrisée à l’aide de contacts métalliques à l’intérieur du nanopore. La lecture des bases serait réalisée lors du passage de l’ADN simple brin au travers du pore (ça rappelle quelque chose…)

– Et Oxford Nanopore dans tout cela ? Si la société anglaise a annoncé la vente de la participation d’Illumina, elle a marqué l’année 2013 par son silence assourdissant. Passé l’oxymore, en cette fin d’année, coup de poker ou réel lancement, Oxford Nanopore propose un programme d’accès à sa technologie Minion où pour 1000 USD, il est possible de postuler à l’achat des clés USB de séquençage.

La stratégie d’Oxford Nanopore est basée, en partie, sur la possible démocratisation du séquençage de 3ème génération, elle s’oppose à celle de PacBio qui mise sur son arrivée précoce sur le secteur du séquençage haut-débit : décentralisation contre l’inverse. En clair, l’investissement d’un PacBio est tel que l’outil est réservé à des centres, des prestataires de services pouvant assumer cet investissement, ce qui oblige à centraliser les échantillons pour les séquencer, contre les produits (encore en développement) d’Oxford Nanopore dont la promesse est : le séquençage pour tous (ou presque).

PacBio revendique sa participation à un projet qui consiste à doubler la quantité de génomes bactériens « terminés » (actuellement de 2384) en quelques mois.

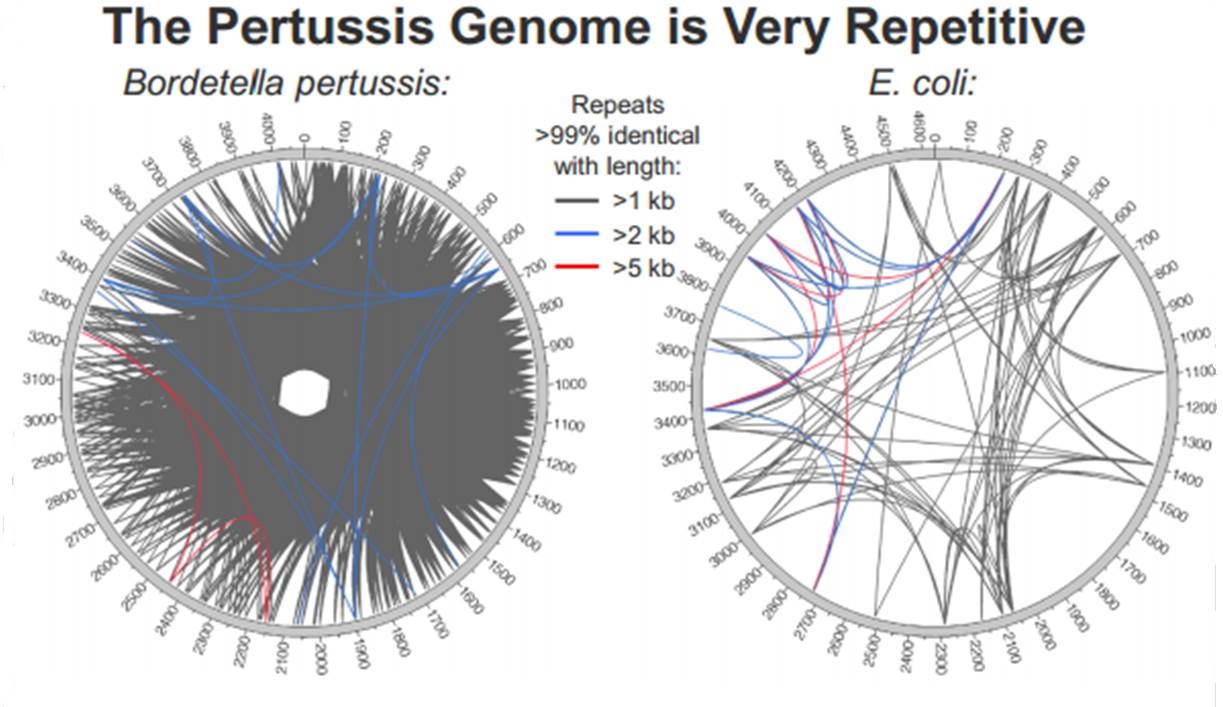

En cliquant ci-dessus sur la représentation graphique qui illustre la différence de plasticité de génome entre le génome d’une Bordetella pertussis (l’agent pathogène responsable de la coqueluche) et celui d’Escherichia coli, un poster vous apparaîtra. Ce dernier reprend les caractéristiques de l’utilisation de la technologie de PacBio à des fins d’assemblage de novo de génomes bactériens par une stratégie non-hybride (seuls des reads de PacBio sont utilisés). Les résultats sont assez bluffants, la longueur des reads de PacBio permet un assemblage complet (au prix de plusieurs SMRT cells tout de même !), de génomes bactériens « difficiles » tel que celui de Bordetella pertussis connu pour posséder un GC % relativement élevé (environ 65 %) ainsi que de nombreux éléments transposables. Les génomes possédant de nombreux éléments répétés posent de grandes difficultés d’assemblage, c’est un des arguments qui permet à PacBio de positionner sa technologie actuellement… en quelques mois les stratégies hybrides (reads courts générés par des séquenceurs de 2ème génération) ont laissé place aux stratégies non-hybrides où le séquençage PacBio se suffit à lui-même.

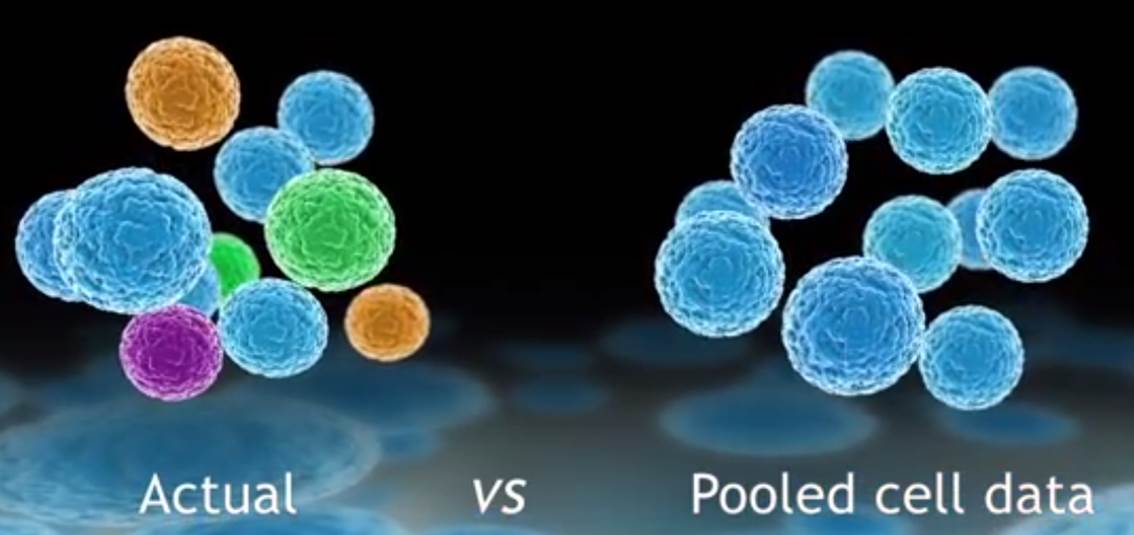

L’évolution des technologies de biologie moléculaire combinée à des systèmes de détection toujours plus sensibles, des techniques d’amplification accessibles dans des systèmes intégrés ont rendu possible l’analyse du transcriptome d’une cellule isolée. Dans de nombreux domaines tels que la cancérologie, la biologie des cellules souches, l’ingénierie des tissus, le signal moyen peut cacher la pertinence du signal noyé dans la masse des cellules d’intérêt.

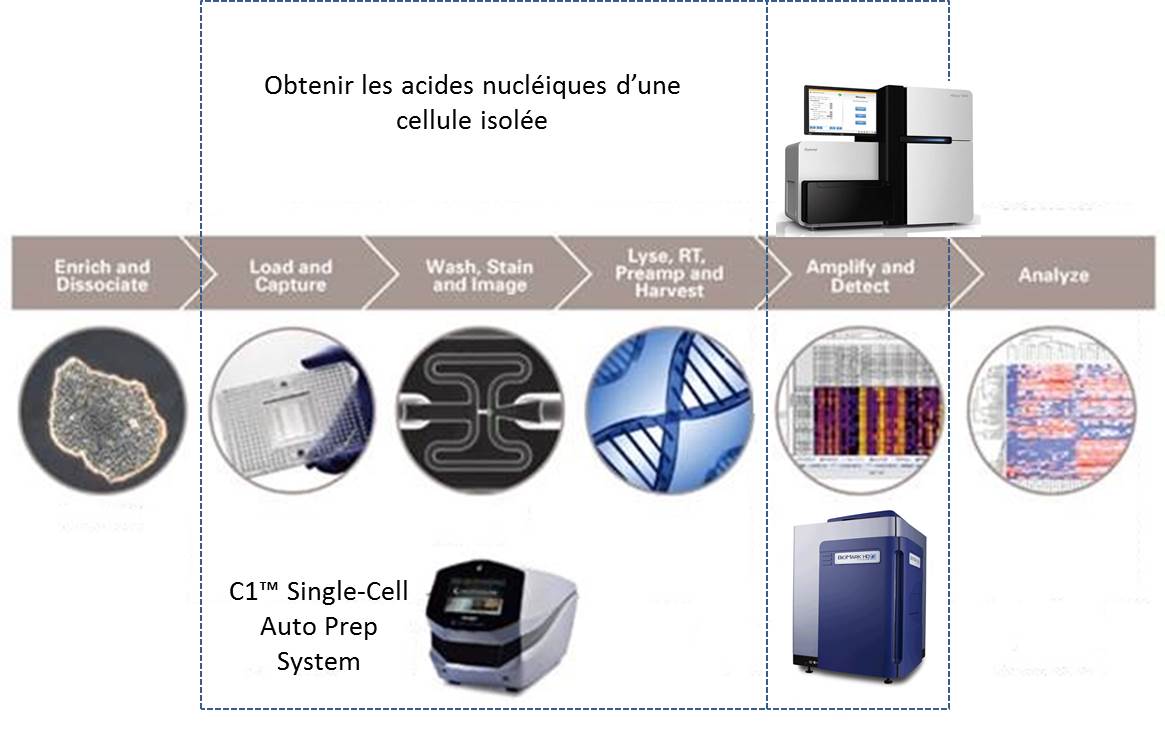

Défier la loi de la moyenne, en tenant compte de l’hétérogénéité cellulaire pour tenter de capter ce signal qui échappe aux systèmes n’analysant que le mélange de cellules, est le credo du système proposé par Fluidigm : le C1™ Single-Cell Auto Prep System.

Isoler des cellules pour extraire leur ARN peut être une tâche technique ardue consommatrice de temps et très sensible aux contaminations.

La société américaine, Fluidigm propose donc un système plutôt simple permettant de capturer quelques cellules pour en extraire leurs acides nucléiques. Le consommable est composé d’une plaque microfluidique comportant 96 pièges à cellules enchaînés. La multiplicité de ces pièges permet d’accroître les chances de capturer une cellule dans l’état escompté. Une fois la phase de capture accomplie, les divers pièges sont individualisés. Un système de by-pass permet de « pousser » chacune des cellules piégées dans une succession de « microréacteurs » isolés enchaînant phases de lyse, de transcription inverse, d’amplification des ARNs (WTA) et de collecte des acides nucléiques amplifiés.

Le schéma ci-dessous reprend les 2 phases principales permettant d’aboutir à l’analyse du transcriptome de cellules isolées :

(i) l’amplification d’ARN de cellules isolées

(ii) l’analyse de ces ARNs

Ainsi que le montre la vidéo promotionnelle ci-dessous le système est compact et se veut simple d’utilisation. Il va de soi, malgré tout, que pour optimiser vos chances de capturer un signal d’intérêt un marquage préalable cellules vivantes/mortes peut s’imposer. Ceci impose aussi d’observer la plaque microfluidique au microscope à fluorescence (en se hâtant quelque peu). Bien évidemment l’adjonction de marqueurs discriminants (anticorps couplés à un agent fluorescent) est la bienvenue.

Cette dernière vidéo aborde le « workflow » aboutissant à l’analyse du transcriptome monocellulaire par Biomark, il va de soi qu’il s’agit là d’une « suggestion de présentation » puisqu’il est possible d’analyser le transcriptome amplifié par le système C1™ Single-Cell Auto Prep System avec un grand nombre de systèmes de qPCR ou de séquençage haut-débit.

http://youtu.be/TF4NJRE4Xg4

L’analyse des biomarqueurs des cellules tumorales circulantes devient un élément majeur de la médecine personnalisée (lire L’enjeu des cellules tumorales circulantes). L’article d’Ashley A. Powell et al. (Single Cell Profiling of Circulating Tumor Cells: Transcriptional Heterogeneity and Diversity from Breast Cancer Cell Lines (Plos One, 2102)) montre l’application de ce système au niveau de l’analyse de « biopsie liquide« .

L’outil proposé par Fluidigm trouve d’ores et déjà des applications cliniques très concrètes : l’analyse de biomarqueurs des cellules tumorales circulantes à visée pronostique.

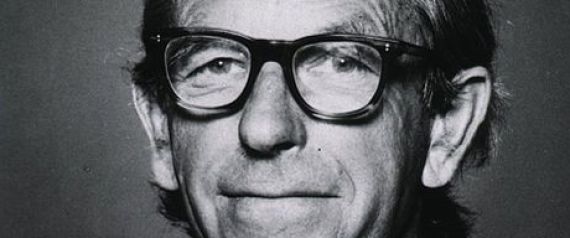

L’un des pionniers des séquences nucléique et protéique est décédé, il y a peu, le 19 novembre 2013, à l’âge de 95 ans. Il avait commencé sa thèse en octobre 1940 avec pour projet de rechercher une protéine consommable purifiée d’herbe (relativement abondante dans le royaume de Georges VI). C’est, au final, sous la direction d’Albert Neuberger (qui avait fuit l’Allemagne avec l’arrivée d’Hitler au pouvoir) que Frederick Sanger devient docteur en 1943.

Les deux hommes se respectaient, à propos de « son maître » Albert, Frédérick Sanger avait déclaré : « c’est Neuberger, qui le premier, m’a appris à faire de la recherche, à la fois techniquement et comme un mode de vie, et je lui dois beaucoup. »

L’homme qui a donné son nom à une technique de séquençage des nucléotides ouvrant la voie à un pan entier d’une science, à un institut de recherche (le Wellcome Trust Sanger Institute) employant plus de 900 personnes est une fierté (jamais anoblie) de l’empire britannique : une des quatre personnes à avoir reçu deux prix Nobel (prix Nobel de chimie). Son premier prix Nobel de chimie pour le séquençage de l’insuline (1958) sanctionne un travail de 10 ans. Rejoignant Crick (le penseur), au laboratoire de biologie moléculaire du Conseil médical de la Recherche à Cambridge, Sanger (le fonceur) se met à développer une technique de séquençage de l’ADN. Ce travail lui apportera son second prix Nobel en 1980.

« Quand j’étais jeune, mon père me disait que les deux activités les plus intéressantes dans la vie sont la recherche de la vérité et de la beauté, et je crois qu’Alfred Nobel a dû ressentir la même chose quand il a donné ces prix pour la littérature et les sciences.«

Un document reprenant le nécessaire à savoir sur l’oeuvre de Frederick Sanger (réalisé par Richard Daniellou, Enseignant-chercheur, ENSCR) est disponible au format pdf.

L’image en tête de cet article est issue d’un portrait de Frederick Sanger réalisé par Paula A. MacArthur (huile sur toile : 1991, collection: National Portrait Gallery de Londres).

Bertrand Jordan a eu son doctorat en physique nucléaire à 1965 et a très bien fait de se convertir à la biologie moléculaire. Entre autres choses, il a réalisé en 1982 l’isolement du premier gène d’histocompatibilité humain, et en 2000, il a fondé la Génopole de Marseille. Bertrand Jordan est membre de l’Organisation européenne de biologie moléculaire (EMBO) ainsi que de l’organisation internationale HUGO (Human Genome Organisation).

Mais surtout, et c’est ce qui nous intéresse ici, l’auteur de plus de 150 publications scientifiques fait œuvre de vulgarisation et offre depuis plus de dix ans, des chroniques génomiques publiées au sein de la revue Médecine / Sciences. Ces chroniques sont accessibles gratuitement (vous pouvez y accéder directement sur le site de www.medecinesciences.org ou en cliquant sur l’image ci dessus en haut à gauche).

On peut vous conseiller de lire le point de vue de Bertrand Jordan sur les séquenceurs haut-débit dans sa chronique de mars 2010 intitulée : le boom des séquenceurs nouvelle génération, sans oublier le point de vue partagé (parfois longtemps après lui) par un nombre croissant de chercheurs sur les GWAS, dans sa chronique de mai 2009 : le déclin de l’empire des GWAS. C’est là tout l’intérêt de ces chroniques qui, bénéficiant d’un propos clair, simple, construit, argumenté et rare, permettent de prendre un peu de recul sur les applications d’une science qui n’ont pas toujours tenu leurs promesses. Ces chroniques peuvent être l’occasion de faire tomber le masque, de dégonfler l’air de ces vessies qui se prennent parfois pour des lanternes.

Bertrand Jordan, chroniqueur mais aussi auteur de quelques livres aux titres évocateurs, parfois mémorablement provocateurs :

Voyage autour du Génome : le tour du monde en 80 labos. Editions Inserm/John Libbey, Paris, 1993

Voyage au pays des gènes. Editions. Les Belles Lettres/ Inserm, Paris, 1995

Génétique et génome, la fin de l’innocence. Editions Flammarion, Paris, 1996

Les imposteurs de la génétique. Editions du Seuil, Paris, 2000 (Prix Roberval Grand Public 2000)

Le chant d’amour des concombres de mer. Editions du Seuil, Paris, 2002

Les marchands de clones. Editions du Seuil, Paris, 2003

Chroniques d’une séquence annoncée. Editions EDK, Paris, 2003

Le clonage, fantasmes et réalité. Essentiel Milan, Editions Milan, 2004

Thérapie génique : espoir ou illusion ? Editions Odile Jacob, Paris, 2007

L’humanité au pluriel : la génétique et les questions de race. Le Seuil, collection Sciences ouvertes, Paris, 2008

Autisme, le gène introuvable : Le Seuil, Paris, 2012

Qui sommes nous?

Christophe Audebert [@]

En charge de la plateforme génomique

du département recherche et développement

de la société Gènes Diffusion .

En charge de la plateforme génomique

du département recherche et développement

de la société Gènes Diffusion .

Renaud Blervaque [@]

Biologiste moléculaire, chargé d'études génomiques.

Biologiste moléculaire, chargé d'études génomiques.

Gaël Even [@]

Responsable bioinformatique au sein

du département recherche et développement de la société Gènes Diffusion.

Responsable bioinformatique au sein

du département recherche et développement de la société Gènes Diffusion.

Catégories

- Analyse de données (14)

- Automatisation (5)

- Bioinformatique (27)

- Biologie (56)

- biologie transverse (35)

- Biotechnologie (30)

- Chronique littéraire (8)

- Comparatif (6)

- Diagnostic (8)

- Economie (17)

- Epidemiologie (2)

- Evénement (17)

- Formation (3)

- Gestion de projet (5)

- Grille de calcul (1)

- Intégration (5)

- Logiciels (8)

- Médecine (14)

- politique de la recherche (17)

- Recherche (21)

- Séquençage (70)

- Séquenceur (39)

- Uncategorized (25)

- Workflow (4)

Accès rapide aux articles

- Covid-19 : zoom sur les vaccins

- Comment l’ADN pourrait être le stockage de données du futur

- COVID-19 : la data visualisation au service de la science

- COVID-19 : des explications et un point d’étape au 20 février 2020

- Pour mettre du vin dans son eau

- Des petits trous, toujours des petits trous…

- Qui serait candidat ?

- Un robot pour analyser vos données…

- Monde de dingue(s)

- L’art et la manière de développer une qPCR

- Un MOOC Coursera sur le WGS bactérien

- Chercheurs & enseignants-chercheurs, l’art du multitâche.

- Un jeu de données métagénomiques

- Facteur d’impact

- Microbiote & smart city : juxtaposition de tendances

Accès mensuels

- février 2021 (1)

- décembre 2020 (1)

- février 2020 (2)

- septembre 2019 (1)

- avril 2018 (2)

- décembre 2017 (1)

- novembre 2017 (2)

- juillet 2017 (2)

- juin 2017 (5)

- mai 2017 (4)

- avril 2017 (3)

- mars 2017 (1)

- janvier 2017 (2)

- décembre 2016 (3)

- novembre 2016 (4)

- octobre 2016 (2)

- septembre 2016 (2)

- août 2016 (3)

- juillet 2016 (2)

- juin 2016 (4)

- mai 2016 (3)

- mars 2016 (1)

- novembre 2015 (2)

- avril 2015 (1)

- novembre 2014 (1)

- septembre 2014 (1)

- juillet 2014 (1)

- juin 2014 (1)

- mai 2014 (1)

- avril 2014 (1)

- mars 2014 (1)

- février 2014 (3)

- janvier 2014 (1)

- décembre 2013 (5)

- novembre 2013 (2)

- octobre 2013 (2)

- septembre 2013 (1)

- juillet 2013 (2)

- juin 2013 (2)

- mai 2013 (4)

- avril 2013 (2)

- mars 2013 (1)

- février 2013 (3)

- janvier 2013 (2)

- décembre 2012 (2)

- novembre 2012 (2)

- octobre 2012 (2)

- septembre 2012 (2)

- août 2012 (1)

- juillet 2012 (3)

- juin 2012 (5)

- mai 2012 (5)

- avril 2012 (6)

- mars 2012 (6)

- février 2012 (8)

- janvier 2012 (6)

- décembre 2011 (5)

- novembre 2011 (6)

- octobre 2011 (6)

- septembre 2011 (7)

- août 2011 (5)

- juillet 2011 (8)

Pages